Nature 보도: 최고 AI 에이전트도 인간 과학자 성과의 절반 — 에이전트 시대의 현실 점검

Nature가 Stanford AI Index 2026을 인용해 보도한 내용에 따르면 최고 성능의 AI 에이전트도 PhD 수준 전문가의 절반 수준 성과만 달성했다. AI 도구가 연구 생산성을 높이되 연구 범위를 좁히는 역설도 발견됐다.

50%. 최고 AI 에이전트가 인간 과학자 대비 달성한 성과 비율이야.

Nature가 이번 주 보도한 내용에 따르면, 현존하는 가장 뛰어난 AI 에이전트도 복잡한 과학 과제에서 PhD 수준 전문가의 절반 정도 성과만 달성했어. Stanford AI Index 2026 보고서(4월 13일 공개, 400페이지 이상)가 근거야.

AI 에이전트가 모든 것을 자동화할 거라는 기대가 팽배한 지금, 이건 꽤 냉정한 현실 점검이야. 원문 기사의 요약이 가장 날카로워. "판단·계획·검증이 필요한 과제에서 에이전트는 아직 주니어 대표 수준이야. 6단계를 안정적으로 연결하지 못하고, 자신이 틀렸을 때도 모르고, 틀릴 때는 과학자의 오후를 통째로 날려버리는 식으로 자신만만하게 틀려."

이 논문이 왜 지금 나왔는지

2025–2026년은 에이전트의 해로 기록돼. Anthropic의 Claude Code, OpenAI의 Codex, Cognition의 Devin, Google의 Jules가 잇따라 출시됐고, 2025년 기업 AI 투자는 전년 2,530억 달러에서 5,810억 달러로 두 배 이상 뛰었어. 벤처 투자의 상당 부분이 에이전트 스타트업에 몰렸지.

분위기는 "에이전트가 조만간 화이트칼라 일자리의 80%를 대체한다"는 전망이 지배했어. 벤치마크 숫자도 급상승했거든. SWE-bench Verified(소프트웨어 엔지니어링)는 60%에서 거의 100%에 근접했고, OSWorld(컴퓨터 작업 자동화)는 12%에서 66%로 올라왔어. Humanity's Last Exam(HLE)도 OpenAI o1(2025)의 8.8%에서 2026년 최고 모델의 50% 초과로 뛰었어.

Stanford AI Index 2026은 이런 마케팅 내러티브에 과학적 현미경을 갖다 댄 보고서야. 특정 벤치마크의 점수만 보면 폭발적 진보처럼 보이지만, 실제 과학 연구처럼 판단·계획·검증이 맞물린 다단계 워크플로우에서는 여전히 격차가 크다는 게 핵심 결론이야.

출처: commons.wikimedia.org · CC-BY-SA 3.0

출처: commons.wikimedia.org · CC-BY-SA 3.0

방법론 해부 — 무엇을 어떻게 측정했는지

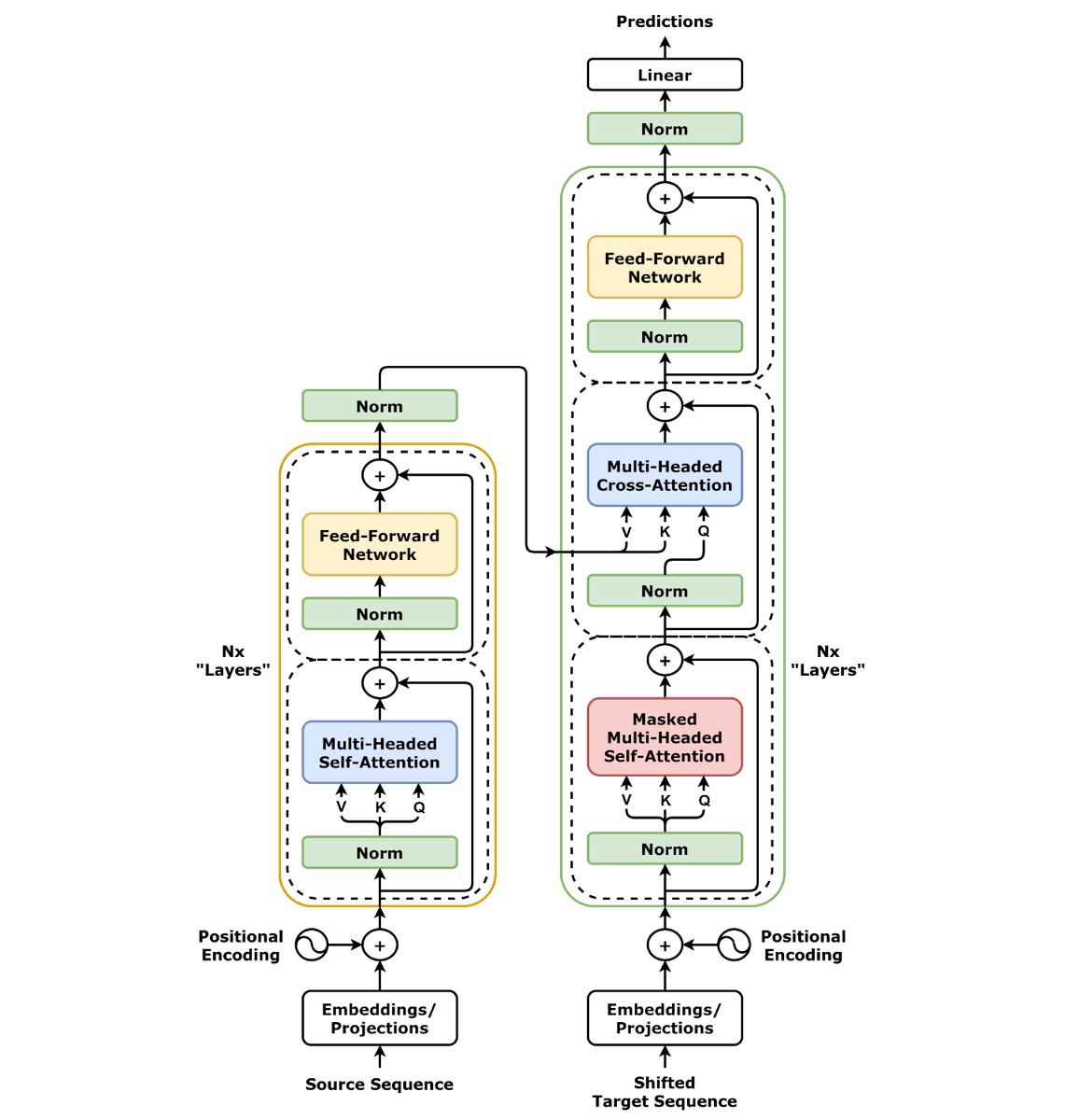

Stanford AI Index 2026은 AI 에이전트 성능을 여러 벤치마크로 교차 측정했어. 챗봇과 에이전트는 근본적으로 다른 시스템이라서, 지표도 다르게 설계해야 하거든.

| 구분 | 챗봇 | AI 에이전트 |

|---|---|---|

| 작동 방식 | 질문-답변 (1회성) | 다단계 자율 수행 |

| 도구 사용 | 제한적 | 코드 실행, API 호출, 파일 조작 등 |

| 계획 수립 | 없음 | 목표 분해 → 단계별 실행 |

| 대표 사례 | ChatGPT (기본), Claude (기본) | Claude Code, Devin, OpenAI Codex |

보고서가 주목한 주요 벤치마크 중 하나는 Humanity's Last Exam(HLE). 분야 최고 전문가들이 직접 출제한 극도로 어려운 문제 세트로, PhD 수준의 추론을 요구해. 또 하나는 OSWorld로, 실제 운영체제에서 컴퓨터를 사용하는 에이전트 태스크를 평가해. 여기에 소프트웨어 엔지니어링을 측정하는 SWE-bench Verified, 아날로그 시계 읽기 같은 기초 지각 과제인 ClockBench까지 포함돼.

흥미로운 건 벤치마크별로 AI 에이전트의 성과가 극도로 갈린다는 점이야. 어떤 과제에서는 인간을 앞지르고, 어떤 과제에서는 크게 뒤쳐져. 연구진이 "들쭉날쭉한 프론티어(jagged frontier)"라고 부르는 현상이야.

결과 — 들쭉날쭉한 프론티어

Stanford AI Index 2026의 벤치마크 숫자를 정리하면 패턴이 선명해져. 단일 스텝·정형화된 과제에서는 모델이 인간을 빠르게 따라잡거나 추월해. 하지만 다단계 판단이 끼어드는 순간 성과가 주저앉아.

| 벤치마크 | 측정 대상 | 2025 기준 최고 | 2026 현재 최고 | 인간 비교 |

|---|---|---|---|---|

| SWE-bench Verified | 소프트웨어 엔지니어링 | ~60% | ~100%에 근접 | 전문가 상회 가능 |

| OSWorld | 운영체제 자동화 | 12% | ~66% | 여전히 33% 실패 |

| Humanity's Last Exam | 다분야 PhD 추론 | 8.8% (o1) | 50% 초과 | PhD 대비 절반 |

| ClockBench | 아날로그 시계 읽기 | — | ~50% | 유아 수준 과제에서 반반 |

| 복잡한 과학 워크플로우 | 실험 설계·실행 | — | ~50% | PhD의 절반 |

핵심 메시지는 "과학 연구 특화 에이전트"에 맞춰져 있어. 연구자들이 자율적으로 실험을 설계하고 수행하는 워크플로우에 AI 에이전트를 투입했더니, 최고 에이전트의 성과가 PhD 전문가의 약 절반에 그쳤어. 특히 6단계 이상 연결이 필요한 태스크에서 에이전트는 중간 단계의 오류를 자각하지 못하고 자신 있게 틀린 답을 쌓아올리는 경향을 보였어.

반면 좁고 반복적인 과제에서의 점수는 놀라울 정도로 올라와. 사이버보안 분류(triage) 과제에서는 15%에서 93%로 뛰었다는 수치도 보고됐어. 즉 에이전트 실력은 "영역 전반"이 아니라 "영역별로 불균형"하게 성장하고 있다는 게 이번 리포트의 구조적 결론이야.

출처: commons.wikimedia.org · CC-BY-SA 4.0

출처: commons.wikimedia.org · CC-BY-SA 4.0

한계 + 비판 — 벤치마크는 지도지 영토가 아냐

이 보고서를 비판적으로 읽는 관점도 짚어두자.

첫째, Humanity's Last Exam 같은 벤치마크의 "PhD 수준"이라는 표현은 논쟁적이야. 문제를 출제한 건 PhD지만, 그 PhD가 자기 전문 분야 밖 문제까지 다 맞히는 건 아니거든. "PhD 대비 절반"이라는 프레이밍은 "전 분야 PhD 평균 대비 절반"으로 읽어야 해. 단일 전문 분야 내 비교는 훨씬 더 복잡해.

둘째, 에이전트 벤치마크는 여전히 발달 초기 단계야. OSWorld, SWE-bench Verified, PaperBench 같은 평가가 등장한 지 1~2년밖에 안 됐고, 태스크 설정이 약간만 바뀌어도 점수가 크게 흔들려. 현재 50%라는 숫자가 "진짜 50%"인지, "이 특정 평가 설정에서 50%"인지 구분이 필요해.

셋째, Nature의 후속 연구는 AI 도구의 다른 함정을 지적해. AI 도구를 사용하는 과학자들은 개인 생산성이 올라가지만, 연구 주제의 다양성이 줄어드는 역설이 나타났어. AI가 "잘 하는" 방향으로 연구가 쏠리니까. 자연과학 분야 논문 중 AI를 언급하는 비율은 이미 6~9%에 도달했고, 이 수렴 현상은 더 심해질 가능성이 높아.

AI 도구가 개별 과학자의 생산성을 높이는 동시에, 과학 전체의 창의적 범위를 좁히고 있다는 건 모순적이면서도 직관적이야. 도구가 특정 방법론을 쉽게 만들면, 사람들은 그 방법론으로 수렴하니까.

필드 맥락 — 에이전트 벤치마크의 계보

AI 에이전트 평가 방법론은 짧은 시간 안에 급격히 진화했어. 아래 타임라인이 그 속도를 잘 보여줘.

| 연도 | 핵심 벤치마크 | 특징 |

|---|---|---|

| 2019 | SuperGLUE | 자연어 이해 중심, 단일 턴 |

| 2021 | MMLU | 57개 분야 지식 측정, PhD 이전 수준 |

| 2023 | HumanEval, GSM8K | 코드·수학 추론, 여전히 단일 태스크 |

| 2024 | SWE-bench, GPQA | 실제 이슈·전문가 지식 기반 |

| 2025 | OSWorld, Humanity's Last Exam | 다단계 에이전트·PhD 수준 문제 |

| 2026 | AI Index 전체 프레임 | 과학 워크플로우 자율 실행 평가 |

2024~2025년을 거치며 평가의 무게중심이 "정답을 맞히는 능력"에서 "작업을 완수하는 능력"으로 이동했어. 그리고 2026년 현재 시점의 결론은 "단일 질문의 정답률은 빠르게 올라왔지만, 6단계 이상 연결되는 작업 완수율은 정체 중"이라는 거야.

출처: commons.wikimedia.org · CC-BY-SA 4.0

출처: commons.wikimedia.org · CC-BY-SA 4.0

더 넓은 그림 — 에이전트 열풍의 현실 점검

2026년 AI 업계의 최대 키워드는 단연 "에이전트"야. Anthropic의 Claude Code, OpenAI의 Codex, Devin 같은 코딩 에이전트들이 잇달아 출시됐고, 벤처 투자의 상당 부분이 에이전트 스타트업에 몰리고 있어. 2025년 미국 기업 AI 투자만 3,440억 달러에 달해.

하지만 Nature 보도가 시사하는 건, 에이전트의 능력이 아직 마케팅이 약속하는 수준에 한참 못 미친다는 점이야. 단순하고 반복적인 작업에서는 뛰어나지만, 복잡한 판단, 창의적 문제 해결, 다단계 추론이 필요한 영역에서는 아직 인간이 압도적으로 우위에 있어. 전문가가 6단계 작업의 중간 오류를 30초 만에 잡아내는 반면, 에이전트는 틀린 가정 위에 세 시간 치 작업을 쌓아올려. 그 오후의 낭비가 실제 비용이야.

이건 에이전트가 쓸모없다는 뜻이 아니야. 적절한 기대치 설정이 필요하다는 뜻이야. 2026년 AI Index의 숫자를 보면 모델이 벤치마크 점수를 올리는 속도는 여전히 빠르지만, 그 점수가 현실 업무로 전이되는 속도는 훨씬 느려.

그래서 뭐가 달라지는데

개발자와 연구자 입장에서 네 가지 시사점이 있어.

첫째, AI 에이전트는 "보조 도구"로 쓸 때 가장 효과적이야. 전체 작업을 맡기기보다, 반복적인 부분을 자동화하고 인간이 복잡한 판단과 창의적 부분을 담당하는 분업 구조가 현재로서는 최선이야. 특히 6단계 이상 연결되는 작업은 인간이 중간 체크포인트를 강제로 끼워넣어야 해.

둘째, "AI가 내 일자리를 대체한다"는 공포는 복잡한 지식 노동 영역에서는 아직 시기상조야. 하지만 단순·반복 영역에서는 이미 빠른 자동화가 진행되고 있어. "AI를 잘 활용하는 사람이 그렇지 못한 사람을 대체한다"는 것도 이미 현실이야. 둘을 구분해서 준비하는 게 중요해.

셋째, AI 도구 사용 시 "다양성 함정"을 의식해야 해. AI가 제안하는 방향으로만 흘러가면 결과물이 획일화돼. Nature 후속 연구가 보여주듯, AI 도구는 개인 생산성을 높이면서 집단 다양성을 떨어뜨리는 구조적 효과가 있어. 의도적으로 AI 제안과 다른 방향을 탐색하는 습관이 경쟁력이 될 수 있어.

넷째, 에이전트 평가 프레임워크를 직접 공부해야 해. SWE-bench, OSWorld, HLE 같은 벤치마크가 어떻게 설계됐는지 알면, 벤더의 점수 마케팅을 제대로 해석할 수 있어. "98% on X-bench" 같은 숫자가 실제 업무 완수율을 의미하지 않는다는 걸 아는 게 기본 소양이야.

참고 자료

- Human scientists trounce the best AI agents on complex tasks (Nature)

- AI tools boost individual scientists but could limit research as a whole (Nature)

- Stanford 2026 AI Index Report (Stanford HAI)

- Stanford's AI Index for 2026 Shows the State of AI (IEEE Spectrum)

- AI Agents Score Half as Well as PhDs on Real Work (Humai.blog)

- Want to understand the current state of AI? Check out these charts (MIT Technology Review)

출처

관련 기사

AI 트렌드를 앞서가세요

매일 아침, 엄선된 AI 뉴스를 받아보세요. 스팸 없음. 언제든 구독 취소.