구글, 국방부와 '기밀 환경 Gemini' 계약 협상 중이야

Alphabet이 미 국방부와 기밀(classified) 환경에 Gemini AI를 배치하는 계약을 협상 중. 자율 무기·국내 대량 감시 사용 금지 조항을 계약에 박아 제안. OpenAI 조건과 사실상 동등한 수준인데, 2018년 Project Maven 항의 이후 구글 내부 분위기는 완전히 달라.

4,000명 → 0명. Maven 때 서명했던 구글 직원 숫자의 반감기야

2018년, Project Maven 반대 청원에 서명한 구글 직원은 약 4,000명. 그 청원이 Sundar Pichai를 움직여 구글은 Maven에서 철수했고 "AI Principles"를 내걸면서 "무기·대량 감시에 쓰이는 AI는 만들지 않겠다"고 못 박았어. 그 8년 뒤인 2026년 4월 16일, The Information이 특종을 터뜨렸어.

Alphabet이 미 국방부(Department of Defense)와 Gemini AI를 기밀(classified) 환경에 배치하는 계약을 협상 중이야.

이번엔 내부 청원도, 철회도 없어. 구글은 이미 2025년 12월부터 비기밀 영역에 Gemini for Government를 공급하고 있고, 이제 air-gapped 기밀 망까지 들어가려고 해. Project Maven이 "예외적 반란"이었다면 이번 딜은 "새로운 표준"이야.

각 주체: Alphabet과 미 국방부

**Alphabet (구글 모회사)**는 2025년 기준 연매출 약 3,500억 달러, 직원 18만 명의 거대 지주회사야. 핵심 수익원은 여전히 광고지만, Google Cloud가 2025년 연간 런레이트 500억 달러를 돌파하면서 미래 성장엔진으로 자리잡았어. Gemini 모델 라인업(Gemini 2.5 Pro, Gemini 3.0 Flash 등)은 GPT-5, Claude Sonnet 4.5, xAI Grok 4와 함께 프런티어 4강 중 하나로 분류돼.

AI 윤리 측면에서 구글은 2018년 이후 지속적으로 포지션을 바꿔왔어. 2025년 초 AI Principles에서 "무기·대량 감시" 명시적 금지 조항이 추상적 거버넌스 언어로 완화됐고, 2024년에는 Project Nimbus(이스라엘 정부 클라우드 계약)에 항의한 직원 약 50명을 해고하면서 내부 반발의 비용을 올렸어. "윤리 기반 거부권"이 Maven 시절처럼 작동하지 않는 환경을 회사가 의식적으로 만들어온 거야.

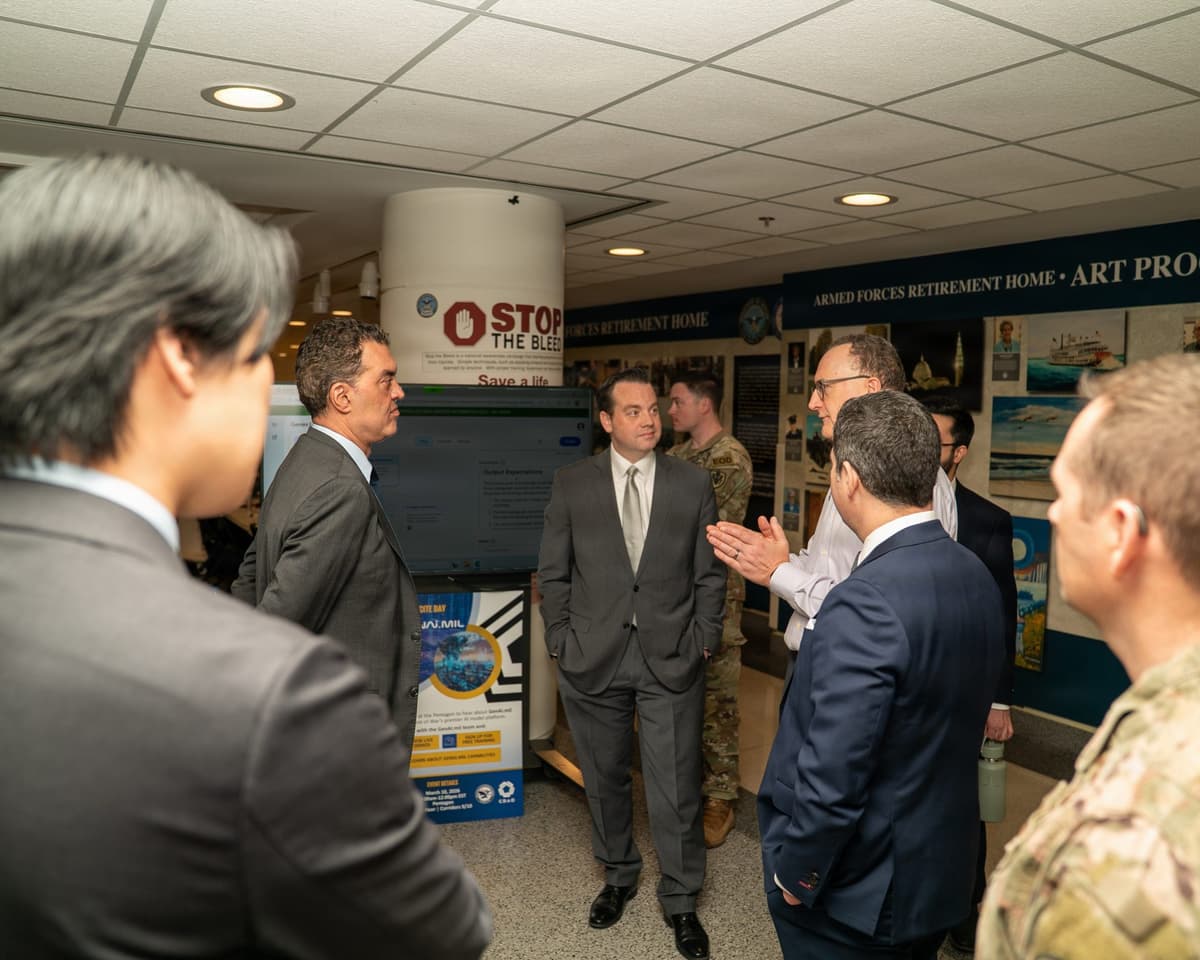

**미 국방부(DoD)**는 연방 예산 약 8,500억 달러를 쓰는 세계 최대 IT 구매자 중 하나야. AI 조달은 Chief Digital and AI Office(CDAO) 산하에서 관리되고, 2025년에는 "GenAI.mil"이라는 전사 AI 플랫폼을 오픈했어. Undersecretary Emil Michael은 이에 대해 "사상 처음으로 300만 명의 군인·공무원·계약자 전원이 책상 위에 AI를 갖게 된다"고 표현했지. Pentagon의 조달 기준은 이제 "어느 벤더를 쓸까"가 아니라 "모든 프런티어 벤더를 동시에 쓸 표준 계약을 어떻게 짤까"로 넘어가는 중이야.

두 주체의 관계는 지난 10년 동안 "협력 → 파열 → 조용한 재결합" 사이클을 거쳤어. 2017년 Maven으로 시작했고, 2018년 구글이 철수. 그러다 2021년 JWCC(Joint Warfighting Cloud Capability) 때 구글이 재입찰에 성공하며 90억 달러 멀티벤더 클라우드 계약의 4개사 중 하나로 복귀했어. 이번 Gemini 기밀 계약은 그 재결합의 가장 깊은 단계야.

출처: breakingdefense.com · US DoD DVIDS 퍼블릭 도메인

출처: breakingdefense.com · US DoD DVIDS 퍼블릭 도메인

협력 구조 – 계약 조건·금액·기간·독점성

이번 협상이 특이한 건 "금액이나 기간이 아직 공개되지 않았다"는 점이야. 보도된 건 조건의 구조적 특징뿐이야. Alphabet은 Pentagon에 대해 "모든 합법적 용도(all lawful uses)"로 Gemini 사용을 허용하되, 두 가지 카브아웃을 계약에 명시하자고 제안 중이야.

| 항목 | 공개된 조건 |

|---|---|

| 협상 공개 시점 | 2026년 4월 16일 (The Information) |

| 사용 범위 | Gemini 전 모델군, classified 환경 포함 |

| 금지 조항 1 | 자율 무기(autonomous weapons) — "적절한 인간 통제(appropriate human control)" 없이 금지 |

| 금지 조항 2 | 국내 대량 감시(domestic mass surveillance) 금지 |

| 독점성 | 비독점 — Pentagon은 OpenAI, Anthropic, xAI와도 병행 계약 |

| 인프라 | Google Cloud의 IL-6 (Top Secret) 인증 리전 활용 예정 |

| 참고 선행 계약 | OpenAI 2026년 초 Pentagon 계약에서 동일 조건 수용 |

가장 중요한 건 "비독점"이라는 대목이야. Pentagon은 이미 OpenAI, Anthropic, xAI와 각각 멀티밀리언 달러 단위의 상한(ceiling) 계약을 맺고 있어. OpenAI는 2024년 말 $200M 규모의 Chief Digital and AI Office 계약을, Anthropic은 2024~2025년 Palantir·AWS 삼자 구도로 classified 환경 Claude 배치를 시작했어. Google이 합류하면 4강이 모두 동일한 조건, 동일한 권리로 Pentagon 안에 들어와.

계약의 실제 금액은 multi-year, multi-hundred-million 범위로 추정돼. OpenAI의 $200M ceiling이 참고점이 되고, Google Cloud가 이미 JWCC의 $9B 계약을 분할 수주하고 있는 상황이라 총액은 그보다 작은 단위지만 "상징적 의미는 훨씬 커". 기밀 영역에서 모델 자체를 공급한다는 건, 인프라 수준의 위탁이 아니라 모델 수준의 위탁이라는 뜻이야.

각자의 이득 — Alphabet에게, Pentagon에게

Alphabet에게는 세 가지 레버가 생겨. 첫째, classified 시장 진입. 이 시장은 진입 장벽이 정말 높아서 한 번 들어가면 수십 년 가는 락인 효과가 있어. AWS GovCloud가 CIA 계약으로 클라우드 정부 시장을 독점했던 구조와 같아. 둘째, Gemini의 "production-grade defense validation". 국방부 IL-6 환경에서 검증된 모델이라는 레퍼런스는 이후 다른 나라 국방부·정보기관 계약에 직접 연결돼. 셋째, Google Cloud 기업가치 방어. Cloud 사업부 성장률이 AWS·Azure 대비 둔화된다는 월가의 우려에 대응할 수 있는 "정부 부문 대형 딜"이 생겨.

Pentagon에게는 "벤더 다양화와 가격 협상력 동시 확보"가 핵심이야. 지금까지 Pentagon은 AI 조달에서 OpenAI의 비중이 과도하게 크다는 우려를 내부적으로 제기해왔어. Google, Anthropic, xAI까지 동일 조건으로 들여오면 벤더 종속 리스크가 분산되고, 경쟁 입찰 구조가 생겨서 가격과 기능 양쪽에서 레버리지가 생겨. 더 중요하게, 각 벤더의 모델 특성이 달라서 — Claude는 장문 분석, GPT는 일반 추론, Gemini는 멀티모달과 Google Search 통합, Grok은 실시간 X 데이터 — 업무별로 최적 모델을 섞을 수 있어.

양쪽 모두에게 공통된 이득도 있어. "AI 거버넌스 산업 표준"을 자신들이 앞장서서 쓰고 있다는 명분. 자율 무기·대량 감시 금지 조항이 계약서에 박힌 채로 시작되면, 이후 민간 엔터프라이즈 계약, 동맹국 정부 계약, EU AI Act 대응에서도 같은 템플릿을 들이밀 수 있어. 일종의 "정부 조달이 민간 AI 윤리 프레임워크를 선도한다"는 역전 현상이야.

출처: commons.wikimedia.org · CC BY-SA 2.0

출처: commons.wikimedia.org · CC BY-SA 2.0

과거 유사 파트너십 — 성공과 실패

Big Tech와 Pentagon의 파트너십은 세 가지 결과로 갈려왔어.

성공 사례 1 — AWS-CIA (2013, $600M). AWS가 CIA와 맺은 6억 달러 클라우드 계약이 정부 클라우드 시장 전체를 열었어. 이 계약으로 AWS GovCloud의 사실상 표준화가 이뤄졌고, 이후 JEDI, JWCC로 이어지는 모든 국방 클라우드 계약의 기반이 됐지. 교훈: classified 진입은 길지만 한 번 들어가면 시장 전체를 재편해.

성공 사례 2 — Palantir-US Army Vantage (2020). Palantir가 Army의 데이터 통합 플랫폼으로 선정돼 연간 수억 달러 매출로 발전했어. 처음엔 파일럿으로 시작했지만 점점 핵심 인프라로 깊어졌지. 교훈: 초기 계약 규모보다 "얼마나 깊이 운영에 박히느냐"가 5년 후 결과를 결정해.

실패 사례 — Google Project Maven (2017~2018). 구글이 Pentagon의 드론 영상 분석 계약을 따냈지만 약 4,000명의 직원 청원으로 1년 만에 철수했어. 당시 대안 벤더가 없어서 Pentagon도 타격이 컸고, Google은 AI Principles를 만들며 공식적으로 물러났지. 교훈: 내부 조직 문화가 방산 계약에 준비되어 있지 않으면 계약 자체가 무너질 수 있어. 2026년 구글은 이 교훈을 뒤집는 쪽으로 조직을 재설계한 셈이야.

또 하나 경계선에 있는 사례가 **Microsoft-US Army IVAS ($22B, HoloLens 기반)**야. 2021년 체결됐지만 제품 결함과 사용자 불만으로 2024년 사실상 계약 구조조정에 들어갔어. 교훈: 거대 계약이라고 성공 보장되는 건 아니고, 실제 현장 효용이 없으면 어떤 억 달러 계약도 무너질 수 있어. Google/Pentagon 계약도 "Gemini를 현장에서 실제로 쓰는 지표"가 몇 년 뒤 재평가 기준이 될 거야.

경쟁자 카운터 플레이

OpenAI는 선점자 이점을 지키는 방향으로 움직여. Sam Altman은 이미 "Pentagon에 모든 AI 회사에게 동일한 조건을 제시해달라"고 공개적으로 요청했는데, 이게 Google 합류의 길을 터준 셈이야. 하지만 OpenAI가 의도했을 가능성이 높아 — 단일 벤더 의존은 정치적으로 지속 불가능했고, 차라리 "공통 표준"을 OpenAI가 주도해서 깐 다음 성능·가격 경쟁으로 이기겠다는 계산이야. OpenAI의 대응은 "Stargate 규모(수천억 달러 데이터센터)"로 인프라 우위를 만드는 방향으로 집중될 거야.

Anthropic의 반응이 가장 미묘해. Newsweek이 "Anthropic fallout 이후"라는 표현을 쓴 이유가 있는데, Anthropic은 최근 Pentagon과의 계약 조건 협상에서 보수적 입장을 유지해왔어. "상업·엔터프라이즈 중심, 방산은 제한적"이라는 포지셔닝이 AI 안전 담론과 연결돼 있고, 그 포지션을 지키는 게 브랜드 가치야. 하지만 Google이 같은 조건으로 들어오는 걸 보면서 "더 방어적 자세를 유지할지, 조건을 맞출지" 내부 논쟁이 심화될 가능성이 커. Dario Amodei가 어떤 라인을 그을지가 관전 포인트야.

xAI는 조직 구조 자체가 Musk의 SpaceX·Starlink·Palantir 커넥션과 맞물려 있어서 Pentagon 진입이 자연스러워. Grok 4의 실시간 정보 처리 능력을 전장 정보 분석에 연결한다는 시나리오가 이미 업계에서 돌고 있고, Musk의 정치적 포지션까지 감안하면 xAI는 오히려 카운터 플레이가 아니라 "치고 나가는" 포지션이야. 중장기적으로 Pentagon 4강 구도(OpenAI-Google-Anthropic-xAI)에서 xAI가 차별화 포인트로 어떤 걸 가져올지가 2026년 하반기 주요 관전 포인트야.

중국 경쟁자 DeepSeek, Qwen, Kimi는 이 판에서 직접 카운터 플레이는 불가능해. 대신 중국 인민해방군(PLA)의 자체 AI 프로그램이 미국 4강 구도에 대응하는 "반대편 표준"으로 가고 있고, 인도·중동·유럽이 미국·중국 AI 중 어느 쪽 계약 표준을 도입할지가 향후 2~3년 글로벌 AI 지정학의 핵심 질문이 될 거야.

그래서 뭐가 달라지는데

Gemini 상업 고객에게는 직접적 영향이 거의 없어. Classified 배치는 air-gapped IL-6 인프라에서 완전히 분리된 채 돌아가고, Google Cloud의 상업용 API와 모델 가중치 공유 경로가 나뉘어 있어. 다만 Google이 "defense-grade 검증"을 마친 모델이라는 마케팅을 엔터프라이즈에 펼칠 수 있게 되는데, 이건 SOC2·HIPAA 인증과 비슷한 형태로 엔터프라이즈 구매 결정에 영향을 줘.

AI 정책 관계자에게는 "연방 조달 계약이 AI 윤리 표준을 앞장서 쓰는 시대"가 열리는 순간이야. Pentagon 계약 템플릿의 두 가지 금지 조항(자율 무기 + 대량 감시)이 EU AI Act 고위험 카테고리와 상당 부분 겹쳐서, 미국과 EU의 AI 규제가 실제 계약 수준에서 수렴하기 시작해. 한국·일본·호주 정부 계약에도 같은 템플릿이 깔릴 가능성이 크고, 이건 글로벌 AI 거버넌스의 핵심 변곡점이야.

구글 엔지니어와 연구자에게는 커리어 선택의 갈림길이야. 2018년 Maven 때는 "청원하면 회사가 철수한다"였지만, 2026년은 "조직이 이미 방산 방향으로 재설계됐다". AI 안전·정렬 연구를 하던 팀들이 점점 classified 배치 대상 모델을 다루게 되고, 이게 불편한 연구자들은 Anthropic이나 스타트업으로 이동하는 흐름이 2026~2027년 내내 이어질 거야. 반대로 방산 도메인 전문가(전직 DoD·정보기관 출신)의 구글 이적이 가속될 거고, 조직 구성 자체가 바뀌는 단계야.

참고 자료

출처

- Pentagon weighs Google's Gemini AI for military use after Anthropic fallout (Newsweek)

- Google In Pentagon Talks to Deploy Gemini AI in Military Settings (CoinCentral)

- Pentagon rolls out GenAI platform using Google's Gemini (Breaking Defense, 2025-12)

- Google AI Principles (Google official)

- Pentagon GenAI.mil launch statement (DVIDS, 2025-12)

관련 기사

AI 트렌드를 앞서가세요

매일 아침, 엄선된 AI 뉴스를 받아보세요. 스팸 없음. 언제든 구독 취소.