AI 칩 공급 대전 — Tesla·ASML·Huawei·FluidStack이 같은 주에 움직였어

Tesla AI5 칩 테이프아웃, ASML이 Q1 2026 가이던스 상향, Huawei 950PR 대량 주문, FluidStack $18B 데이터센터. 모델보다 칩이 병목이라는 현실이 한 주에 정리됐어.

한 주 동안 칩 업계에 네 번의 큰 신호가 떴어

이번 주 AI 업계는 "칩이 진짜 문제"라는 사실을 4일 연속으로 확인했어.

월요일 ASML이 Q1 2026 실적을 발표하면서 2026 연간 매출 가이던스를 €38B~€42B로 상향했어. EUV 장비 주문이 예상보다 훨씬 많다는 뜻이야. 같은 날 Huawei 950PR 칩이 ByteDance와 Alibaba에서 대량 주문을 받았다는 소식이 Reuters를 통해 나왔지. 수요일 FluidStack이 Series C $1B을 유치하면서 $18B 규모 데이터센터 계획을 공개했고, 목요일 Electrek이 Tesla AI5 칩 테이프아웃을 보도했어. TSMC 애리조나 팹과 삼성 텍사스 팹에서 듀얼 소스 생산이 확정됐지.

각 뉴스는 독립적이지만, 같이 모아놓으면 이야기가 분명해져. 2026년 AI의 진짜 병목은 칩이야. 모델이 아니라.

이걸 이해하려면

2023년만 해도 AI 병목에 대한 담론은 "데이터"였어. "좋은 데이터가 없으면 모델을 못 키운다." 그 다음 해엔 "모델 자체"가 병목이었어. "GPT-4를 넘는 모델을 누가 먼저 내느냐."

2025년부터 병목이 빠르게 이동했어.

| 연도 | 주요 병목 | 대표 회사 |

|---|---|---|

| 2022 | 파라미터 스케일 | OpenAI, Google |

| 2023 | 학습 데이터 | Scale AI, Anthropic |

| 2024 | 추론 최적화 | Together, Groq |

| 2025 | 전력·냉각 | Equinix, Digital Realty |

| 2026 | 칩 공급 | TSMC, ASML, Huawei |

2026년의 병목은 명확해졌어. GPU가 없어. NVIDIA 할당이 18개월 대기고, H200은 이미 2027년분까지 매진이야. 그리고 NVIDIA 칩을 받아도 패키징과 HBM(고대역폭 메모리)이 부족해서 실제 생산이 지연돼.

이 상황에서 네 가지 방향이 생겼어. NVIDIA 의존을 줄이는 자체 칩(Tesla, Apple, Anthropic-Broadcom), 서방 제재를 우회하는 국산 대안(Huawei 950PR, 화홍 반도체), 칩을 쌓아두는 초대형 데이터센터(FluidStack, CoreWeave), 그리고 생산 장비 자체의 증설(ASML EUV).

이번 주에 네 방향이 모두 한 번씩 뉴스를 쏘았어.

핵심 내용 해부

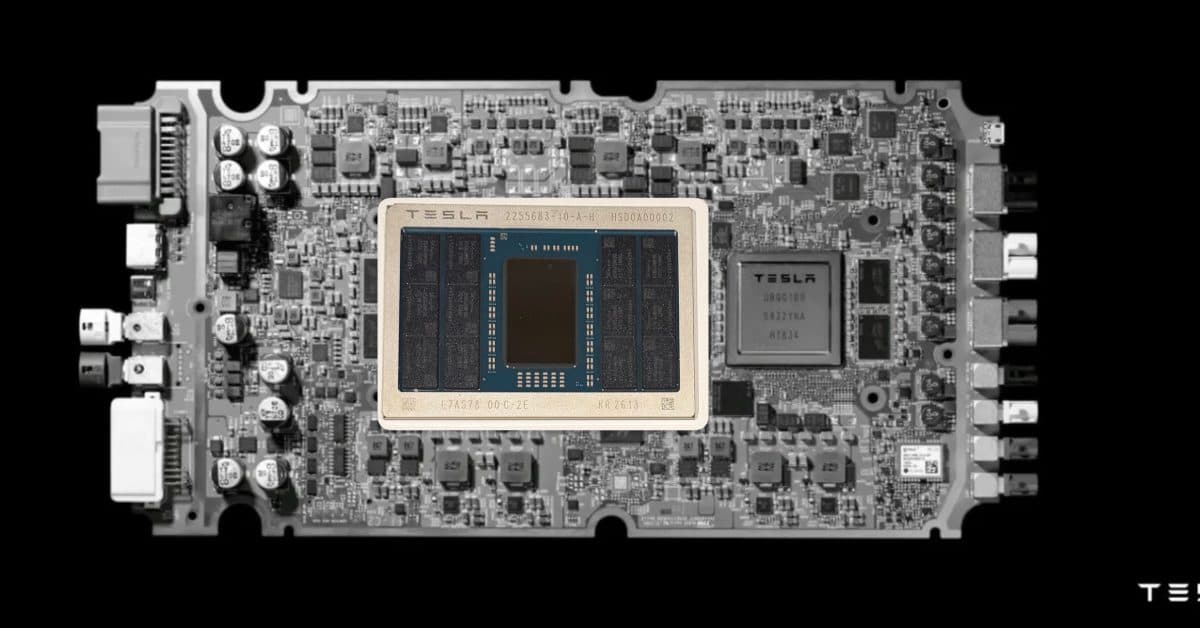

Tesla AI5 — 단일 칩에 192GB LPDDR5X

Tesla AI5의 스펙은 기존 자동차 전용 칩을 넘어서 풀스택 AI 추론 칩의 영역으로 이동했어.

단일 칩 H100 수준 추론 성능. 192GB LPDDR5X 메모리. 3nm 공정. 그리고 TSMC 애리조나와 삼성 텍사스 팹에서 듀얼 소스 생산. 이 결합은 Tesla가 칩을 자율주행용만이 아니라 xAI Grok 훈련과 추론에도 쓸 수 있게 만든다는 의미야.

일론 머스크는 이미 AI6와 Dojo 3 로드맵도 발표했어. AI6은 2028년 양산 목표로 HBM4 탑재, Dojo 3는 완전 자체 칩셋 클러스터로 설계 중이야. 2027년 AI5 양산 직후 바로 다음 세대로 점프하겠다는 계획이야.

| 스펙 | AI4 (2024) | AI5 (2027 양산 목표) |

|---|---|---|

| 공정 | 7nm | 3nm |

| 메모리 | 32GB LPDDR4X | 192GB LPDDR5X |

| FP16 성능 | 37 TFLOPS | 1,500 TFLOPS (추정) |

| 소비전력 | 40W | 400W |

| 생산 | TSMC only | TSMC + 삼성 듀얼 |

듀얼 소스 생산이 특히 중요해. TSMC 한 곳에 의존하는 리스크를 털어내는 동시에, 삼성 3nm 라인의 AI 고객 확보 신호이기도 해. 삼성 파운드리가 2025년 TSMC에 뒤처진 격차를 AI 고객으로 좁히고 있다는 증거야.

ASML 가이던스 상향 — 장비 수주가 훨씬 많아

ASML이 Q1 2026 실적 발표에서 연간 가이던스를 €36B~€40B에서 €38B~€42B로 상향했어. 2026년 전체로 치면 EUV 장비 주문이 약 €4B 더 많다는 뜻이야.

ASML의 고객은 TSMC, 삼성, Intel, SK하이닉스뿐이야. 이 네 회사가 장비를 더 사겠다는 건 AI 칩 생산 라인이 계속 확장된다는 직접적인 증거지.

EUV 장비는 납기 18~24개월이야. 지금 주문한 장비가 2028년에 가동된다는 소리야. ASML 수주량은 2028년 AI 칩 공급량을 미리 보여주는 선행 지표라는 얘기지. 이번 상향은 2028년에도 AI 인프라 수요가 식지 않는다는 업계 합의를 반영해.

Huawei 950PR — 중국의 자체 공급망

Huawei 950PR은 중국 내 ByteDance와 Alibaba로부터 대량 주문을 받았어. 공개되지 않았지만 분석가 추정 규모는 50만 장, 총 계약 가치 약 $9B.

950PR은 H100 대비 추론 성능 약 70% 수준이지만, 가격은 40% 저렴하고 무엇보다 미국 수출 제재와 무관해. ByteDance는 TikTok·도유인(Douyin) 추천 AI에 쓸 예정이고, Alibaba는 Qwen 모델 학습과 Alimama 광고 최적화에 배정한다고 알려졌어.

중국 AI 생태계가 NVIDIA 의존에서 벗어나는 속도가 이번 주 구체적 숫자로 확인됐어. 중국 내 AI 훈련 GPU 시장에서 Huawei 점유율이 2025년 22%에서 2026년 Q1에 41%로 뛰었다는 IDC 보고서가 같이 나왔지.

FluidStack $18B 데이터센터 — 칩을 쌓는 경쟁

FluidStack은 Meta의 투자를 포함해 Series C $1B을 유치했고, 향후 $18B 규모 데이터센터 파이프라인을 공개했어.

핵심 포인트는 FluidStack이 자체 전력망을 갖춘 "neocloud"라는 포지션이야. 기존 AWS·Azure처럼 공용 클라우드에 AI 워크로드를 얹는 게 아니라, 처음부터 AI 훈련·추론만을 위해 설계된 데이터센터를 파는 거지. 단일 사이트당 500MW, 총 20개 사이트, 2028년까지 완공 목표야.

CoreWeave, Crusoe, Lambda Labs에 이어 FluidStack이 합류하면서 neocloud 시장 상위 4개사의 2028년 합산 CAPEX가 $220B을 넘게 됐어. 기존 하이퍼스케일러 3사(AWS, Azure, GCP)의 AI 인프라 투자를 추월하는 규모야.

더 넓은 그림

이번 주 네 뉴스를 연결하면 글로벌 AI 칩 공급망이 3개 블록으로 갈라지는 그림이 보여.

미국 블록은 NVIDIA, AMD, Intel, 그리고 자체 칩을 가진 하이퍼스케일러들(Anthropic-Broadcom, Google TPU, Tesla AI5). 유럽은 ASML이라는 장비 독점으로 엮여 있고, 리소그래피 장비 시장의 80%를 단독 공급해. 중국 블록은 Huawei 950PR과 화홍 반도체가 내수 시장을 중심으로 독자 생태계를 구축 중이야.

세 블록이 완전히 분리되는 건 아니야. ASML은 미국과 중국 모두에 장비를 팔고, TSMC는 NVIDIA뿐 아니라 Tesla, Apple, 심지어 일부 중국 고객에게도 생산해줘. 하지만 방향성은 분명해. 2020년대 후반 AI 인프라는 지정학적 블록별로 따로 굴러갈 거야.

이게 모델 개발에도 영향을 줘. Tesla가 AI5로 Grok을 학습시키면 NVIDIA 벤치마크와 호환이 안 되는 고유한 최적화가 필요해져. Huawei 950PR에서 돌리는 Qwen은 CUDA 생태계를 벗어난 자체 스택이 필요해. "모델만 잘 만들면 된다"는 시대는 끝났어. 이제 "어떤 칩에서 어떤 스택으로 돌리느냐"가 성능을 결정해.

그래서 뭐가 달라지는데

개발자와 기업에 이번 주 변화는 직접적이야.

첫째, 클라우드 선택이 복잡해졌어. AWS·Azure·GCP만 비교하던 시대가 끝났고, CoreWeave·FluidStack·Crusoe 같은 neocloud들이 AI 전용 가격으로 40~60% 저렴하게 GPU 시간을 팔아. 대규모 훈련 작업이라면 이들을 진지하게 검토해야 해. 비용 차이가 수백억 원 규모로 벌어질 수 있어.

둘째, 모델 포팅 비용이 다시 중요해졌어. PyTorch·JAX만 쓰면 되던 시절이 끝나고, 어떤 칩에서 돌릴지가 모델 아키텍처 결정에도 영향을 미쳐. Huawei MindSpore, Tesla의 자체 런타임, Google JAX TPU — 각각 다른 최적화 철학을 가졌고, 포팅에 6~12개월이 들어.

셋째, 한국 시장에 기회가 있어. 삼성 파운드리가 Tesla AI5 듀얼 소스로 확보한 이번 계약은 향후 3년간 한국 반도체 업계에 큰 수익 기반이 돼. SK하이닉스는 HBM4에서 우위를 유지하고 있고, 네이버·카카오는 Huawei 중국 블록과 서방 블록 사이에서 균형을 잡아야 해.

그리고 개인 투자자 관점에선 이번 주가 중요한 리밸런싱 신호야. AI 모델 레이어(OpenAI, Anthropic)의 평가 가치는 이미 $500B을 넘었어. 반면 실제 AI를 굴리는 칩·전력·냉각 인프라 회사들의 평가 가치는 상대적으로 저평가돼 있지. Applied Materials, Lam Research, Arista Networks 같은 이름들이 내년 이맘때쯤 뉴스 헤드라인을 더 많이 장식할 거야.

참고 자료

출처

관련 기사

AI 트렌드를 앞서가세요

매일 아침, 엄선된 AI 뉴스를 받아보세요. 스팸 없음. 언제든 구독 취소.