7주 만에 95,600스타 -- Nous Research의 자기개선 에이전트 Hermes Agent

스스로 평가하고, 스스로 개선하는 AI 에이전트 프레임워크가 오픈소스 역사상 가장 빠른 성장 속도 중 하나를 기록했다. 하루 1,500스타씩 올라간 이유를 뜯어본다.

"스스로 더 나은 에이전트가 되겠습니다" -- 이 한 줄이 95K 스타를 만들었다

AI 에이전트 프레임워크는 이미 수십 개가 있어. LangChain, smolagents, CrewAI, AutoGen. 그런데 2월 25일에 등장한 Hermes Agent가 7주 만에 95,600스타를 찍었어. 하루 평균 1,500스타. 뭔가 다른 게 있다는 뜻이야.

핵심은 "자기개선(self-improvement)" 루프야. 에이전트가 작업을 수행하고, 자기 결과를 평가하고, 그 평가를 기반으로 스스로 파인튜닝하는 구조. 인간이 개입하지 않아도 돌아가는 완전 자율 개선 사이클을 구현했어.

Nous Research는 누구인가

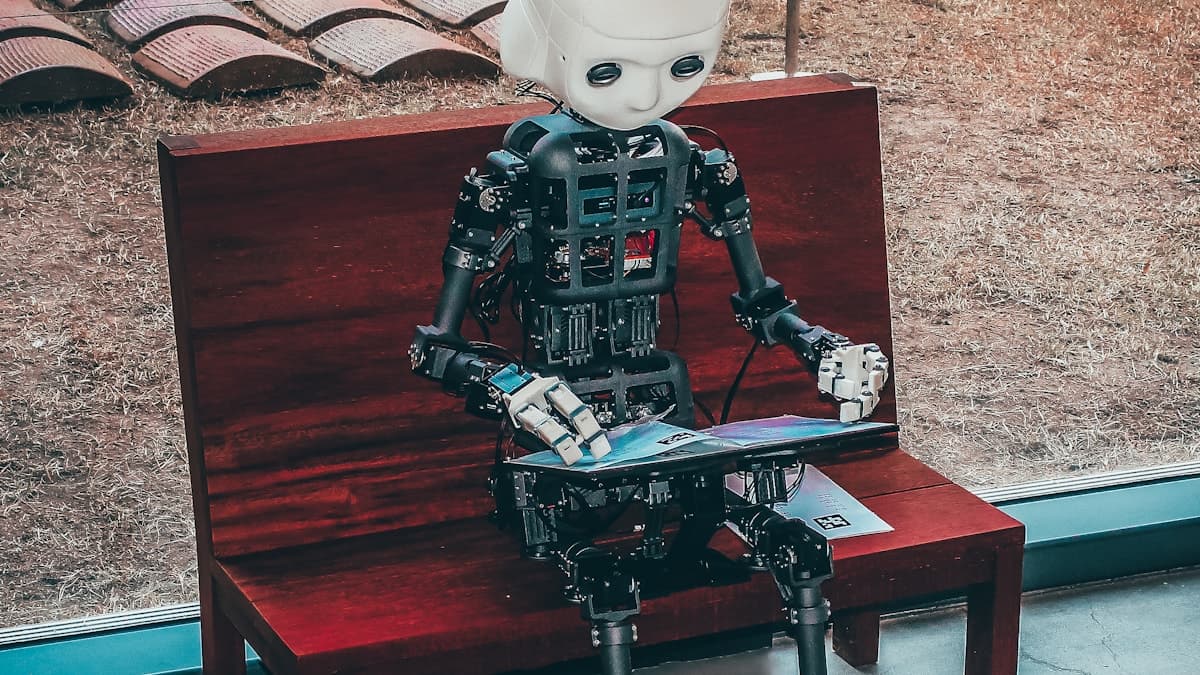

Nous Research의 Hermes 모델 시리즈 발전 과정

Nous Research의 Hermes 모델 시리즈 발전 과정

Nous Research는 오픈소스 LLM 커뮤니티에서 꽤 유명한 팀이야. Hermes 시리즈 파인튜닝 모델로 이름을 알렸어. Hermes-2-Mistral, Hermes-3-Llama 등 커뮤니티 기반 파인튜닝 모델들이 Hugging Face에서 꾸준히 상위권을 차지했거든.

이번에 공개한 Hermes Agent는 그 파인튜닝 노하우를 에이전트 프레임워크에 녹인 거야. 단순히 LLM을 감싸는 래퍼(wrapper)가 아니라, 에이전트가 자기 행동 궤적(trace)을 학습 데이터로 재활용하는 구조를 내장한 프레임워크야.

기술 스택

- 언어: Python

- ML 프레임워크: PyTorch

- API 서버: FastAPI

- 패키지 관리: uv (Astral의 초고속 Python 패키지 매니저)

- 라이선스: Apache-2.0

uv를 기본 패키지 매니저로 채택한 건 꽤 의미 있어. pip 대비 10-100배 빠른 설치 속도를 제공하는 uv를 공식 지원한다는 건, 개발자 경험(DX)을 진지하게 고려했다는 신호야.

핵심 기능 5가지

1. Reflection Loop with Self-Eval (자기평가 반성 루프)

에이전트가 작업을 완료하면 결과를 자기 스스로 평가해. "이 답변이 맞았나?", "더 효율적인 방법이 있었나?"를 자체 LLM 호출로 판단하고, 개선 포인트를 로그에 남겨. 이 로그가 다음 작업의 컨텍스트로 들어가면서 점진적으로 성능이 올라가는 구조야.

2. Trace-Based RL Fine-Tuning (궤적 기반 강화학습 파인튜닝)

여기서 진짜 차별점이 나와. 에이전트의 행동 궤적(어떤 도구를 호출했고, 어떤 순서로 했고, 결과가 어땠는지)을 수집해서 RL(강화학습) 파인튜닝 데이터로 변환해. 성공한 궤적은 positive reward, 실패한 궤적은 negative reward로 자동 라벨링되고, 이걸로 기반 모델을 재학습시킬 수 있어.

3. Tool Registry (도구 레지스트리)

플러그인 방식으로 도구를 등록하고 관리해. MCP(Model Context Protocol)와도 호환돼. 자체 Python 함수를 도구로 등록하거나, 외부 API를 래핑해서 도구화할 수 있어.

4. Multi-LLM Router (멀티 LLM 라우터)

하나의 에이전트가 여러 LLM을 동시에 사용할 수 있어. 간단한 작업은 소형 모델(Mistral, Phi-3)로, 복잡한 추론은 대형 모델(Claude, GPT-5)로 라우팅하는 구조야. 비용 최적화에 직접적인 영향을 줘.

5. Async Task Graphs (비동기 태스크 그래프)

병렬로 실행할 수 있는 하위 작업을 자동으로 식별하고, DAG(방향 비순환 그래프) 형태로 실행 계획을 짜. 10개의 파일을 동시에 분석하거나, 여러 API를 동시에 호출하는 식의 병렬 처리가 기본 내장돼 있어.

경쟁 프레임워크 비교

| 프레임워크 | 스타 | 자기개선 | 멀티 LLM | RL 파인튜닝 | 라이선스 |

|---|---|---|---|---|---|

| Hermes Agent | 95.6K | 내장 | 내장 라우터 | 궤적 기반 자동 | Apache-2.0 |

| LangChain | 102K | 없음 | 수동 설정 | 없음 | MIT |

| smolagents | 18K | 없음 | 제한적 | 없음 | Apache-2.0 |

| CrewAI | 28K | 없음 | 지원 | 없음 | MIT |

| AutoGen | 41K | 제한적 | 지원 | 없음 | MIT |

LangChain이 스타 수에서는 아직 앞서지만, 성장 속도가 완전히 다른 차원이야. LangChain은 2년에 걸쳐 102K를 달성했고, Hermes Agent는 7주 만에 95.6K를 찍었어.

왜 이렇게 빨리 퍼졌나

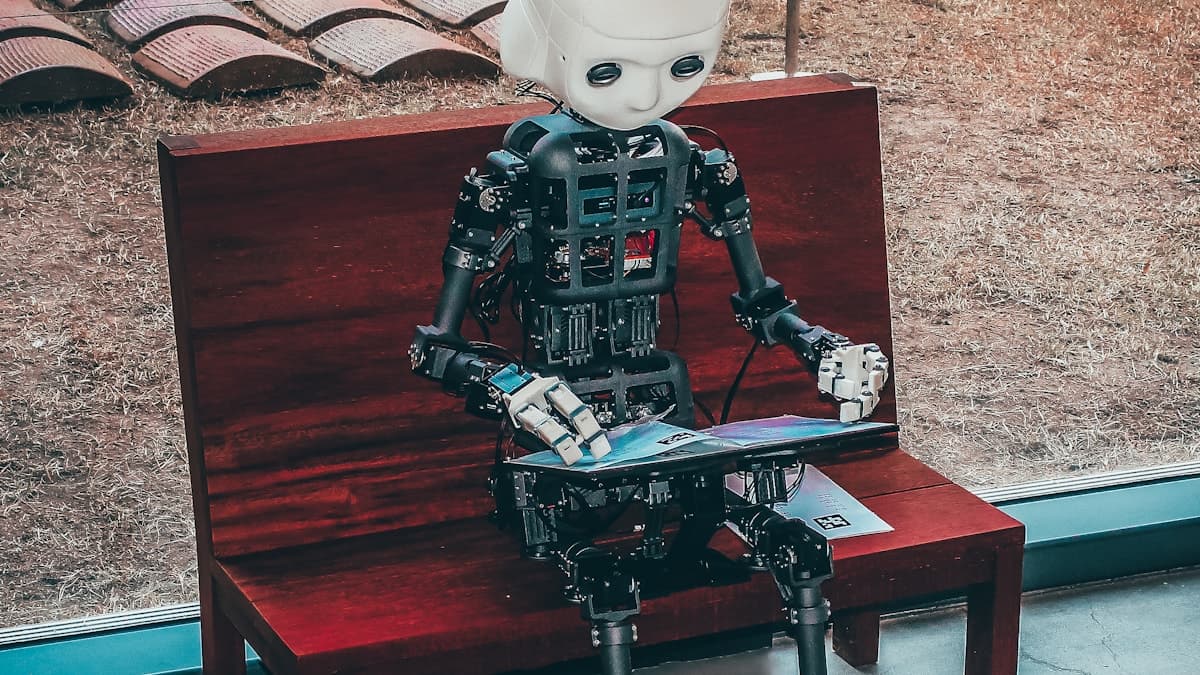

7주간 스타 성장 추이 -- 일평균 1,500스타의 폭발적 성장

7주간 스타 성장 추이 -- 일평균 1,500스타의 폭발적 성장

세 가지 요인이 있어.

첫째, 타이밍이야. 2026년 초부터 "에이전트 피로감"이 쌓이고 있었어. 프레임워크는 많은데, 실제로 프로덕션에서 쓸 만한 건 별로 없다는 불만이 커지던 시점이었거든. Hermes Agent는 "자기개선"이라는 차별화 포인트로 이 피로감을 뚫었어.

둘째, Nous Research의 커뮤니티 신뢰도야. Hermes 시리즈 모델로 이미 검증된 팀이라 "또 다른 장난감 프레임워크"가 아니라 "이 팀이 만들었으면 진짜겠네"라는 반응이 나왔어.

셋째, 실제로 작동한다는 거야. DEV Community 리뷰에 따르면, 간단한 이메일 요약 에이전트를 만들어서 3일간 자기개선 루프를 돌렸더니 응답 품질이 눈에 띄게 좋아졌다는 후기가 올라왔어. "데모만 멋진 프레임워크"와 "실제로 쓸 수 있는 프레임워크"의 차이를 보여준 거지.

생태계 맥락에서 보면

Hermes Agent의 등장은 에이전트 프레임워크 시장의 세대교체를 보여줘. 1세대(LangChain, LlamaIndex)는 "LLM에 도구를 연결한다"가 핵심이었어. 2세대(CrewAI, AutoGen)는 "여러 에이전트가 협업한다"가 포인트였고.

Hermes Agent는 3세대라고 볼 수 있어. "에이전트가 자기 자신을 개선한다"는 패러다임이야. 이건 Nous Research가 원래 강점을 가진 파인튜닝 영역과 에이전트 프레임워크를 결합한 결과야.

Google의 ADK(Agent Development Kit)가 엔터프라이즈 배포와 Vertex AI 통합에 집중하고, HuggingFace의 smolagents가 가벼움과 접근성에 집중한다면, Hermes Agent는 "자율 개선"이라는 완전히 다른 축을 잡았어. 이 세 프레임워크가 2026년 하반기 에이전트 생태계의 삼각 구도를 형성할 가능성이 높아.

시작하기

pip install hermes-agent

hermes init my-agent

hermes run --task "summarize my inbox"

세 줄이면 기본 에이전트가 돌아가. hermes init은 프로젝트 스캐폴딩을 만들고, hermes run은 지정한 태스크를 실행해. 자기개선 루프를 활성화하려면 --self-improve 플래그를 추가하면 돼.

자기개선 모드를 켜면 에이전트가 매 작업 후 자체 평가를 실행하고, 개선 로그를 .hermes/traces/ 디렉토리에 저장해. 이 궤적 데이터를 기반으로 hermes finetune 명령어로 기반 모델을 재학습시킬 수 있어.

이런 사람에게는 안 맞아

- 간단한 RAG 파이프라인만 필요한 경우: LlamaIndex가 더 적합해

- 엔터프라이즈 배포가 최우선인 경우: Google ADK나 AWS Bedrock Agents가 더 나아

- Python이 아닌 언어로 작업하는 경우: 현재 Python만 지원해

- GPU 없이 자기개선 루프를 돌리려는 경우: RL 파인튜닝에는 최소 A100 급 GPU가 필요해

다음 마일스톤

Hermes Agent 2026 로드맵 미리보기

Hermes Agent 2026 로드맵 미리보기

- v0.3 (5월): MCP 서버 내장 지원, 메모리 백엔드 플러그인

- v0.4 (6월): 분산 에이전트 실행(multi-node), WebSocket 기반 실시간 모니터링

- v1.0 (Q3): 프로덕션 안정화, 엔터프라이즈 지원 시작

7주 만에 10만 스타에 근접한 프레임워크. "자기개선 에이전트"가 유행어가 아니라 실제 작동하는 기술이 된 순간이야.

References

관련 기사

OpenClaw — 클라우드 없이 돌아가는 개인 AI 비서가 25만 스타를 찍은 이유

로컬에서 돌아가고, WhatsApp·Telegram·Slack·iMessage까지 50개 플랫폼을 연결하는 개인 AI 에이전트. 주말 프로젝트가 깃허브 역사상 가장 빠른 성장을 기록했다.

GPQA 32% -- HuggingFace의 AI 인턴이 10시간 만에 Claude Code를 이겼다

논문 검색부터 데이터셋 발굴, 학습 스크립트 작성, 평가, 반복까지 LLM 후학습 전 과정을 자동화하는 오픈소스 에이전트. 6,800스타, 하루 260개씩 증가 중.

ML 후학습을 통째로 자동화하는 AI 인턴 -- HuggingFace ml-intern PH 론칭

논문 검색부터 데이터 수집, 학습, 평가까지 LLM 후학습 전 과정을 자동으로 돌리는 오픈소스 에이전트. Product Hunt 365 업보트.

AI 트렌드를 앞서가세요

매일 아침, 엄선된 AI 뉴스를 받아보세요. 스팸 없음. 언제든 구독 취소.