펜타곤, 8개사와 기밀 AI 계약 체결하며 Anthropic만 제외 — 'supply chain risk' 낙인의 전말

미 국방부가 IL6/IL7 기밀 AI 계약을 OpenAI, Google, Microsoft 등 8개사와 체결했지만 Anthropic은 배제했다. 'supply chain risk' 라벨의 배경과 900억 달러 밸류에이션을 앞둔 Anthropic의 딜레마를 해부한다.

8 vs 1

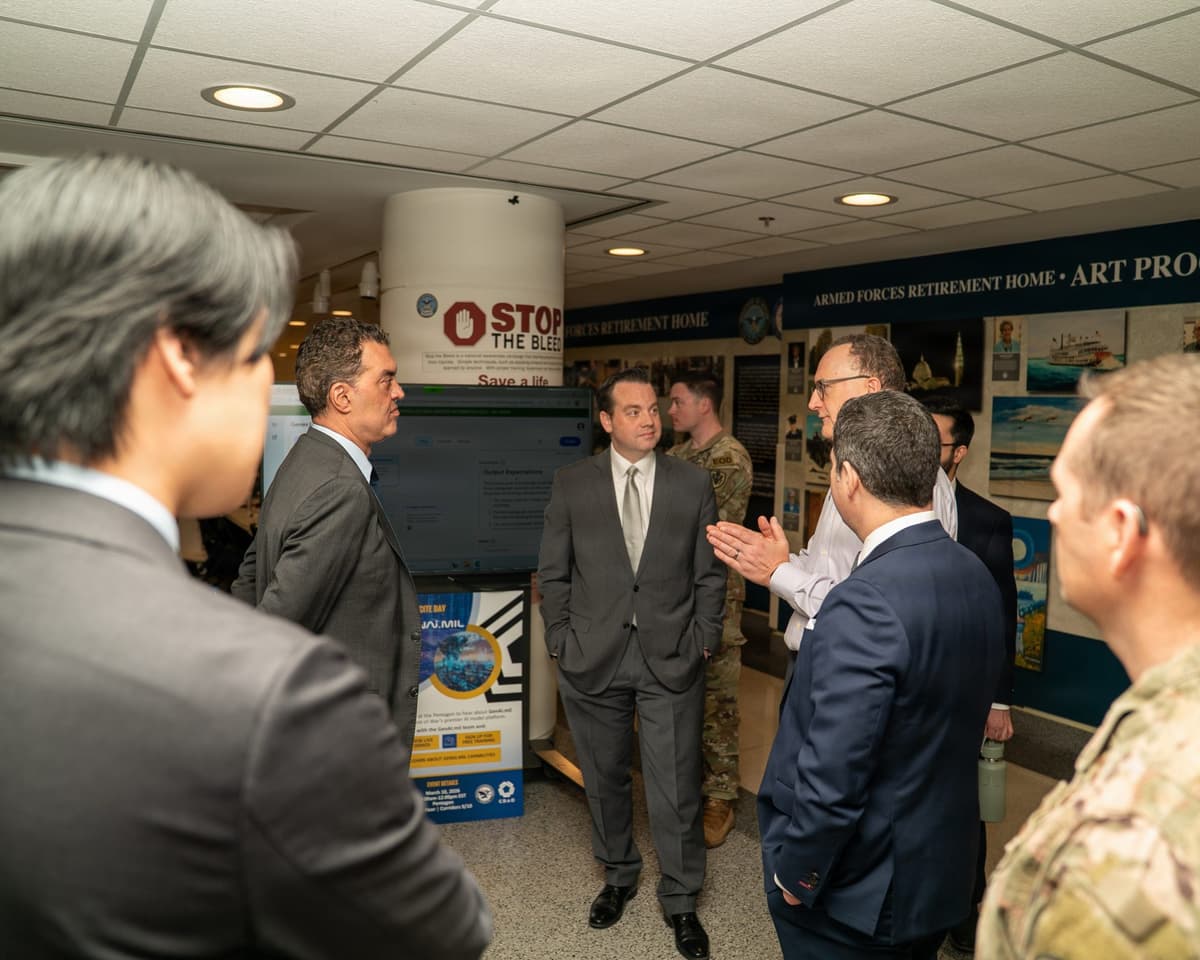

5월 1일, 미 국방부(DoD)가 기밀 네트워크에서 AI를 돌리기 위한 IL6/IL7 계약을 체결했어. 계약 상대는 OpenAI, Google, Microsoft, AWS, Nvidia, SpaceX, Reflection AI, Oracle. 총 8개사야. 빠진 이름이 하나 있어. Anthropic. 미국에서 가장 안전한 AI를 만든다고 주장하는 그 회사가, 미국 국방부의 가장 민감한 AI 계약에서 유일하게 찍혀 나간 거야.

같은 주에 Anthropic은 900억 달러 밸류에이션 라운드를 검토 중이라는 보도가 나왔어. 시장에서는 역사상 가장 비싼 AI 스타트업이 될 수 있다는 얘기가 돌고 있는데, 정작 자국 정부의 기밀 AI 시장에서는 문전박대를 당하고 있는 셈이야. 이 모순이 단순한 해프닝일까, 아니면 AI 산업의 구조적 균열을 보여주는 신호일까.

IL6/IL7이 뭔데 -- 미국 국방부 AI 보안 등급 해부

미 국방부는 클라우드와 AI 서비스를 보안 수준에 따라 Impact Level(IL)로 분류해. 숫자가 올라갈수록 더 민감한 데이터를 다룰 수 있다는 뜻이야. 일반적인 상업용 클라우드는 IL2 정도에 해당하고, 통제된 비기밀 정보(CUI)는 IL4나 IL5에서 처리돼. 여기까지는 많은 클라우드 업체들이 인증을 받아서 운영하고 있어.

IL6부터는 차원이 달라져. IL6은 기밀(classified) 데이터를 처리할 수 있는 등급이야. 군사 작전 계획, 정보기관의 분석 보고서, 무기 체계 사양서 같은 것들이 여기서 돌아가. 물리적 시설부터 네트워크 아키텍처, 인력 보안 심사까지 전부 국방부 기준을 통과해야 해.

IL7은 그 위야. 최고기밀(Top Secret) 및 국가 안보 핵심 정보를 다루는 등급이야. 핵 작전, 전략 정보, 특수 접근 프로그램(SAP) 같은 것들이 IL7 환경에서 처리돼. 여기에 접근하려면 단순히 기술적 요건만 충족하는 게 아니라, 회사의 공급망 전체가 심사 대상이 돼. 어떤 나라에서 부품을 조달하는지, 누가 투자했는지, 직원들의 국적 구성은 어떤지까지 전부 검토한다는 거야.

이번 계약의 의미는 명확해. DoD가 IL6/IL7 수준에서 AI를 본격적으로 돌리겠다는 건, 기밀 네트워크 안에서 대규모 언어 모델(LLM)이 실시간으로 작동하는 시대가 열렸다는 뜻이야. 정보 분석, 위협 탐지, 작전 계획 수립, 문서 요약 같은 작업을 AI가 기밀 환경에서 직접 수행하게 되는 거지.

여기서 중요한 건, 이 등급의 계약을 따낸다는 건 단순히 "좋은 AI 모델을 만드는 회사"라는 인정을 넘어선다는 거야. 미국 정부가 해당 기업의 기술, 보안 체계, 공급망, 거버넌스 구조를 전면적으로 신뢰한다는 선언이거든. 반대로, 여기서 배제된다는 건 기술적 능력과 무관하게 "신뢰할 수 없다"는 판정을 받은 것과 같아.

8개사 명단 -- 누가 들어갔나

이번에 IL6/IL7 계약을 체결한 8개 기업의 면면을 보면, 미 국방부가 AI 전략을 어떤 방향으로 짜고 있는지가 드러나.

| 기업 | 핵심 역할 | 기존 국방 이력 |

|---|---|---|

| Microsoft | Azure Government Secret/Top Secret 클라우드 + AI 통합 | JEDI 후속 JWCC 계약, 이미 IL6 인증 보유 |

| Vertex AI 기밀 환경 배포, Gemini 모델 | Project Maven 논란 이후 국방 사업 재진입 | |

| AWS | GovCloud IL6 인프라 + Bedrock AI 서비스 | CIA 클라우드 계약(C2E) 운영 중 |

| OpenAI | GPT 계열 모델 기밀 네트워크 배포 | 2024년 국방 정책 전환 후 첫 기밀 계약 |

| Nvidia | AI 훈련/추론 GPU 하드웨어 + 소프트웨어 스택 | 국방부 AI 인프라의 사실상 표준 |

| SpaceX | Starshield 위성 통신 + 엣지 AI 배포 | 이미 국가안보우주발사(NSSL) 계약자 |

| Oracle | OCI Government 클라우드 + 데이터베이스 | 국방부 ERP 시스템 장기 운영 |

| Reflection AI | 차세대 AI 모델 (개발 중) | 신규 진입, 아직 상용 모델 미출시 |

Microsoft, AWS, Oracle은 이미 국방부 클라우드 인프라의 핵심 공급자들이야. 이들이 포함된 건 당연한 수순이지. Google은 2018년 Project Maven 논란으로 군사 AI에서 손을 뗐다가, 이후 조용히 국방 사업에 복귀했어. 이번 계약은 그 복귀가 완전히 이루어졌다는 확인이야.

OpenAI가 들어간 건 주목할 만해. 2023년까지만 해도 OpenAI는 군사 목적 사용을 금지하는 정책을 갖고 있었어. 2024년 1월에 해당 조항을 삭제하면서 국방 시장에 문을 열었고, 이번에 기밀 등급 계약까지 따낸 거야. "all lawful purposes" 조항을 수용했다는 뜻이기도 해.

SpaceX는 위성 통신과 엣지 컴퓨팅 관점에서 포함된 거야. 전장의 말단까지 AI를 배포하려면 Starshield 같은 군용 위성 네트워크가 필수적이거든. Nvidia는 하드웨어 측면에서 대체 불가능한 위치에 있고.

가장 눈에 띄는 건 Reflection AI야. 이 회사는 아직 상용 모델조차 출시하지 않았어. 250억 달러 밸류에이션 협상 중이라는 보도만 나왔을 뿐이야. 모델도 없는 회사가 IL6/IL7 계약에 이름을 올린 반면, Claude라는 검증된 모델을 가진 Anthropic은 빠졌어. 이 대조가 시사하는 바가 커.

Anthropic만 빠진 이유 -- 'supply chain risk' 라벨의 전말

Anthropic이 배제된 표면적 이유는 단순해. 국방부가 Anthropic에 'supply chain risk' 라벨을 붙였기 때문이야. 하지만 그 라벨이 붙게 된 과정은 단순하지 않아.

시작은 2025년으로 거슬러 올라가. 미 국방부는 AI 서비스 제공업체들에게 "all lawful purposes" 조항이 포함된 계약서에 서명할 것을 요구했어. 이 조항의 핵심은, 국방부가 해당 AI를 합법적인 모든 목적에 사용할 수 있다는 거야. 여기에는 표적 선정, 드론 작전 지원, 자율무기 시스템 통합 같은 군사적 활용이 포함될 수 있어.

Anthropic은 이 조항에 서명하기를 거부했어. 회사의 Acceptable Use Policy(AUP)에는 AI를 사용해 "사람에게 심각한 해를 가하는 것"을 금지하는 조항이 있고, 자율무기 시스템에 대한 명시적 제한도 있거든. Anthropic의 입장은, 자신들의 안전 정책과 양립할 수 없는 용도에 대해 백지수표를 줄 수 없다는 거였어.

2026년 초, 국방부는 Anthropic을 공식적으로 'supply chain risk'로 분류했어. 이건 기술적 결함이나 보안 취약점 때문이 아니야. 계약 조건에 대한 이견, 즉 사용 목적 제한을 고집하는 Anthropic의 태도가 "안정적 공급을 보장할 수 없는 리스크"로 해석된 거야.

Anthropic은 가만히 있지 않았어. 연방법원에 국방부를 상대로 소송을 제기했어. 소장의 핵심 주장은 두 가지야. 첫째, 'supply chain risk' 분류가 자의적이고 사실에 기반하지 않는다는 것. 둘째, 이 분류가 실질적으로 Anthropic을 국방 시장에서 영구 배제하는 효과를 가져, 적법 절차 없이 재산권을 침해한다는 거야.

소송은 현재 진행 중이야. 하지만 소송이 진행되는 동안에도 국방부는 이번 8개사 계약을 밀어붙였어. 법적 다툼의 결과를 기다리지 않고 기정사실을 만든 셈이야.

타임라인을 정리하면 이래:

| 시점 | 사건 |

|---|---|

| 2024년 1월 | OpenAI, 군사 사용 금지 조항 삭제 |

| 2025년 상반기 | DoD, AI 업체들에 "all lawful purposes" 조항 서명 요구 |

| 2025년 하반기 | Anthropic, 해당 조항 서명 거부 |

| 2026년 초 | DoD, Anthropic을 'supply chain risk'로 분류 |

| 2026년 3월 | Anthropic, 연방법원에 DoD 상대 소송 제기 |

| 2026년 4월 19일 | NSA가 Anthropic의 Mythos Preview 운용 중이라는 보도 (Axios) |

| 2026년 5월 1일 | DoD, 8개사와 IL6/IL7 계약 체결, Anthropic 배제 |

이 타임라인에서 가장 아이러니한 건, Anthropic이 "AI 안전"을 가장 강하게 주장하는 회사라는 거야. Constitutional AI, Responsible Scaling Policy, 그리고 AI 안전 연구에 가장 많은 자원을 투입하는 기업이 국가 안보 계약에서는 "리스크"로 분류됐어. "안전한 AI를 만든다"와 "국가 안보에 안전한 공급자"는 전혀 다른 개념이라는 걸 이 사례가 보여주는 거야.

Mythos 패러독스 -- NSA는 쓰고 DoD는 거부

여기서 이야기가 더 복잡해져. 4월 19일, Axios가 보도한 바에 따르면 NSA(국가안보국)가 이미 Anthropic의 Mythos Preview를 운용 중이야. Mythos는 Anthropic이 개발한 사이버 방어 특화 모델이야. 네트워크 침입 탐지, 위협 분석, 취약점 평가 같은 작업에 최적화되어 있지.

같은 정부, 같은 안보 체계 안에서 NSA는 Anthropic의 모델을 쓰고 있고, DoD는 Anthropic을 'supply chain risk'로 찍어서 배제하고 있어. 이게 말이 돼?

5월 1일 CNBC 인터뷰에서 국방부 CTO 에밀 마이클(Emil Michael)은 이 모순에 대해 이렇게 답했어. "블랙리스트는 유지되지만, Mythos는 별개의 이슈다." 이 발언을 해석하면, 국방부는 Anthropic을 "전면적 파트너"로는 받아들이지 않지만, 특정 도구가 필요할 때는 예외를 두겠다는 입장인 거야.

이건 몇 가지를 시사해. 첫째, 국방부 내에서도 Anthropic 배제에 대한 의견이 갈려 있을 가능성이 높아. 사이버 방어 영역에서 Mythos의 성능이 대체 불가능하다면, 현장 지휘관이나 기술 담당자들은 "정치적 이유로 최고의 도구를 못 쓴다"고 불만을 가질 수 있거든.

둘째, NSA와 DoD의 조달 체계가 다르다는 점도 있어. NSA는 자체적인 기술 평가 및 조달 프로세스를 운영하고, DoD의 'supply chain risk' 분류가 NSA에 자동 적용되지는 않아. 하지만 같은 행정부 안에서 이런 불일치가 장기간 지속되기는 어려워.

셋째, 이 상황은 Anthropic에게 묘한 레버리지를 줘. "당신들이 우리를 배제했지만, 당신들의 가장 민감한 기관이 우리 모델을 쓰고 있다"는 건 법정에서 강력한 논거가 될 수 있거든. 'supply chain risk'라는 분류의 근거가 얼마나 취약한지를 보여주는 증거이기도 하고.

에밀 마이클의 "별개의 이슈" 발언은 아마도 이런 법적 리스크를 인식한 상태에서 나온 방어적 답변이었을 거야. 하지만 이 발언 자체가 "우리의 기준이 일관적이지 않다"는 걸 인정하는 셈이기도 해.

Reflection AI의 깜짝 등장 -- 모델 없이 계약받은 회사

이번 8개사 명단에서 가장 의외의 이름은 Reflection AI야. 이 회사는 2025년에 설립됐고, 현재 250억 달러 밸류에이션으로 투자 유치를 협상 중이라는 보도만 나와 있어. 상용 모델을 출시한 적이 없어. 공개된 벤치마크도 없고, 고객 사례도 없어.

그런 회사가 IL6/IL7 계약에 이름을 올렸다는 건, 국방부가 "현재의 모델 성능"이 아니라 "미래의 기술 접근권"을 확보하려는 전략적 판단을 했다는 뜻이야. Reflection AI의 창업 팀이 누구인지, 어떤 기술적 비전을 가지고 있는지가 계약 체결의 핵심 변수였을 가능성이 높아.

이 상황은 Anthropic의 배제를 더 날카롭게 만들어. Claude 3.5 Opus, Claude 4 같은 검증된 프론티어 모델을 보유하고, 수백만 명의 사용자와 엔터프라이즈 고객을 가진 Anthropic은 배제하면서, 모델 하나 없는 신생 기업은 포함한 거야. 이건 "기술력"이 기준이 아니라는 걸 명확히 보여줘. 기준은 "계약 조건 수용 의지"와 "정부의 모든 용도에 대한 무조건적 협력"이었던 거야.

스테이크 -- 누가 이기고 누가 지나

이번 계약의 파급력을 Winners / Losers / Watch 프레임으로 정리해볼게.

Winners

OpenAI가 가장 큰 수혜자야. 2023년까지 군사 사용을 금지했던 회사가, 불과 2년 만에 미국 최고 기밀 AI 계약의 핵심 파트너가 됐어. Sam Altman의 정책 전환이 완벽하게 먹힌 셈이야. Google도 Project Maven의 그림자에서 완전히 벗어났어. Nvidia는 AI 칩이 국방 인프라의 표준이 되면서 반도체 지배력이 한층 더 굳어졌고.

SpaceX는 지상 인프라를 넘어 우주 기반 AI 배포라는 새로운 영역을 개척하게 됐어. Elon Musk가 xAI(Grok)가 아닌 SpaceX 이름으로 국방 AI에 들어간 건, 인프라와 모델을 분리해서 접근하는 영리한 전략이야.

Losers

Anthropic은 당장의 매출 타격보다 더 큰 문제에 직면해. 국방 시장 배제는 그 자체로 "이 회사는 미국 정부의 신뢰를 받지 못한다"는 시그널이거든. 900억 달러 밸류에이션 라운드를 앞둔 시점에서 이건 투자자들에게 불편한 질문을 던져. "미국 정부가 신뢰하지 않는 AI 회사에 900억 달러 가치가 있나?"

물론 반론도 가능해. Anthropic의 소비자/엔터프라이즈 시장은 국방과 별개이고, AI 안전에 대한 원칙적 입장이 장기적으로는 자산이 될 수 있다는 거야. 하지만 당장은 아파.

Watch

Reflection AI의 향후 행보를 지켜봐야 해. 모델 없이 계약을 받았으니, 실제로 IL6/IL7 수준의 모델을 얼마나 빨리 만들어내느냐가 관건이야. 만약 실패하면, 국방부의 판단력 자체에 의문이 제기될 거고.

Anthropic의 소송 결과도 핵심 관전 포인트야. 만약 법원이 'supply chain risk' 분류를 자의적이라고 판단하면, 국방부는 기존 계약 구조를 재검토해야 할 수 있어.

회의론자 -- "원칙의 대가" vs "30년 뒤 자랑"

이 사안에 대한 시각은 크게 둘로 갈려.

한쪽에서는 Anthropic의 결정을 순진한 이상주의로 봐. 전직 국방부 조달 관료인 마이클 브라운(Michael Brown, 전 DIU 국장)은 Defense News 인터뷰에서 "국방부와 일하고 싶으면 국방부의 규칙을 따라야 한다. 기업의 내부 정책이 국가 안보보다 우선할 수는 없다"고 말했어. 이 시각에서 보면, Anthropic은 수십억 달러 규모의 시장을 자발적으로 포기한 셈이야.

다른 쪽에서는 Anthropic의 입장을 "30년 뒤에 자랑할 수 있는 결정"으로 봐. AI 안전 연구자 스튜어트 러셀(Stuart Russell)은 "자율무기에 대한 제한 없이 AI를 제공하는 건, 기술 기업이 가장 하지 말아야 할 일"이라는 입장을 반복적으로 밝혀왔어. Anthropic이 단기적 손실을 감수하면서라도 이 원칙을 지킨다면, AI 거버넌스 역사에서 중요한 선례가 될 수 있다는 거야.

현실적으로는 둘 다 맞는 면이 있어. 국방부 입장에서 "사용 목적을 우리가 통제하지 못하는 AI는 기밀 환경에 넣을 수 없다"는 논리는 합리적이야. 동시에 Anthropic 입장에서 "어떤 용도로든 쓸 수 있게 하라는 건 안전 정책의 존재 이유를 부정하는 것"이라는 논리도 합리적이고. 이건 어느 한쪽이 명백히 틀린 문제가 아니라, AI 시대의 근본적인 긴장 관계를 드러내는 사례야.

내일 아침에 할 것

이 뉴스를 접한 사람들이 실제로 취할 수 있는 액션을 역할별로 정리해봤어.

개발자/엔지니어라면:

국방/정부 AI 시장에 관심 있다면, IL6/IL7 인증 요건을 공부해. FedRAMP High, DISA STIG, 그리고 각 클라우드 프로바이더의 GovCloud 아키텍처를 이해하는 게 진입점이야. 특히 Microsoft Azure Government, AWS GovCloud의 개발 환경은 상업용과 상당히 다르니까, 해당 환경에서의 개발 경험이 차별화 요소가 될 수 있어.

Anthropic의 Claude API를 쓰고 있는 국방 관련 프로젝트가 있다면, 리스크 플랜을 점검해. 당장은 상업용 API에 영향이 없지만, 향후 규제 환경에 따라 정부 관련 프로젝트에서 Anthropic 모델 사용이 제한될 가능성은 열어둬야 해.

스타트업 창업자라면:

정부/국방 AI 시장 진출을 고려한다면, "all lawful purposes" 조항 수용이 사실상 필수 조건이라는 게 이번에 확인됐어. Acceptable Use Policy를 설계할 때 이 점을 처음부터 고려해야 해. 나중에 바꾸려면 Anthropic처럼 큰 대가를 치를 수 있어.

동시에, Anthropic이 빠진 틈새를 노리는 것도 전략이 될 수 있어. 국방부가 다양한 AI 공급자를 원하는 건 분명하니까, IL6 인증 과정을 밟으면서 국방 특화 모델이나 서비스를 개발하는 건 유효한 경로야.

투자자라면:

Anthropic의 900억 달러 밸류에이션을 평가할 때, 국방 시장 배제가 TAM(Total Addressable Market)에 미치는 영향을 계량화해봐. 미국 국방 AI 시장은 2026년 기준 연간 약 150억 달러 규모로 추산돼. 이건 전체 AI 시장의 일부지만, 마진이 높고 장기 계약이라 안정적인 매출원이거든.

반면, Anthropic의 소송이 성공하면 상황이 뒤집힐 수도 있어. 법적 리스크를 양방향으로 평가하는 게 중요해. 그리고 Reflection AI에 투자를 검토 중이라면, "국방부 계약을 따낸 회사"라는 타이틀의 무게를 신중하게 판단해. 모델 없이 계약을 받은 건 기회이자 리스크야.

참고 자료

| 매체 | 제목 | 링크 |

|---|---|---|

| DefenseScoop | DoD Expands Classified AI Work with 8 Companies, Excluding Anthropic | defensescoop.com |

| CNBC | Pentagon Anthropic Blacklist: Mythos Is "Separate Issue," Says Emil Michael | cnbc.com |

| Breaking Defense | Pentagon Clears 7 Tech Firms to Deploy Their AI on Its Classified Networks | breakingdefense.com |

| Federal News Network | DoD Strikes Deals with Major Tech Firms to Deploy AI on Classified Networks | federalnewsnetwork.com |

| Defense News | Pentagon Freezes Out Anthropic as It Signs Deals with AI Rivals | defensenews.com |

관련 기사

엔터프라이즈 AI 다년 계약의 시대 — Stellantis·Pentagon·HumanX가 증명한 것

Stellantis–MS 5년 100툴 공동 개발, Google–Pentagon 기밀 환경 배치, HumanX 현장의 Claude 열풍. 이번 주에 AI가 파일럿에서 벗어나 IT 예산의 메인 항목으로 확정됐어.

펜타곤이 빅테크 AI를 기밀망 안으로 들였다 — 7개사 동시 계약의 의미

미 국방부가 마이크로소프트·아마존·구글·앤트로픽 등 7개 프론티어 AI 기업과 기밀 펜타곤 컴퓨터망에 모델을 배치하는 계약을 동시에 체결했다. 행정 자동화에 머물던 군의 AI가 정보·작전·지휘 영역으로 본격 진입했음을 보여주는 신호다.

OpenAI 연매출 $25B 돌파, 상장을 준비한다 — AI 수익화 시대의 전환점

OpenAI가 연간 매출 $25B을 넘어섰고 2026년 말 IPO를 검토 중이다. Anthropic도 $19B에 근접. AI 기업의 수익 모델이 실험에서 검증으로 전환되는 순간.

AI 트렌드를 앞서가세요

매일 아침, 엄선된 AI 뉴스를 받아보세요. 스팸 없음. 언제든 구독 취소.