NVIDIA GTC 2026: 에이전틱 AI가 주인공, Vera CPU로 병목 깨겠다

GTC 2026의 핵심은 에이전틱 AI야. AI가 챗봇에서 자율 에이전트로 진화하면서 CPU가 새로운 병목이 됐어

인트로 훅: AI가 드디어 손을 놨어

챗봇이 답변하고 끝이었던 시대는 지났어. 이제 AI는 사람이 시킨 일을 혼자 해낸다고.

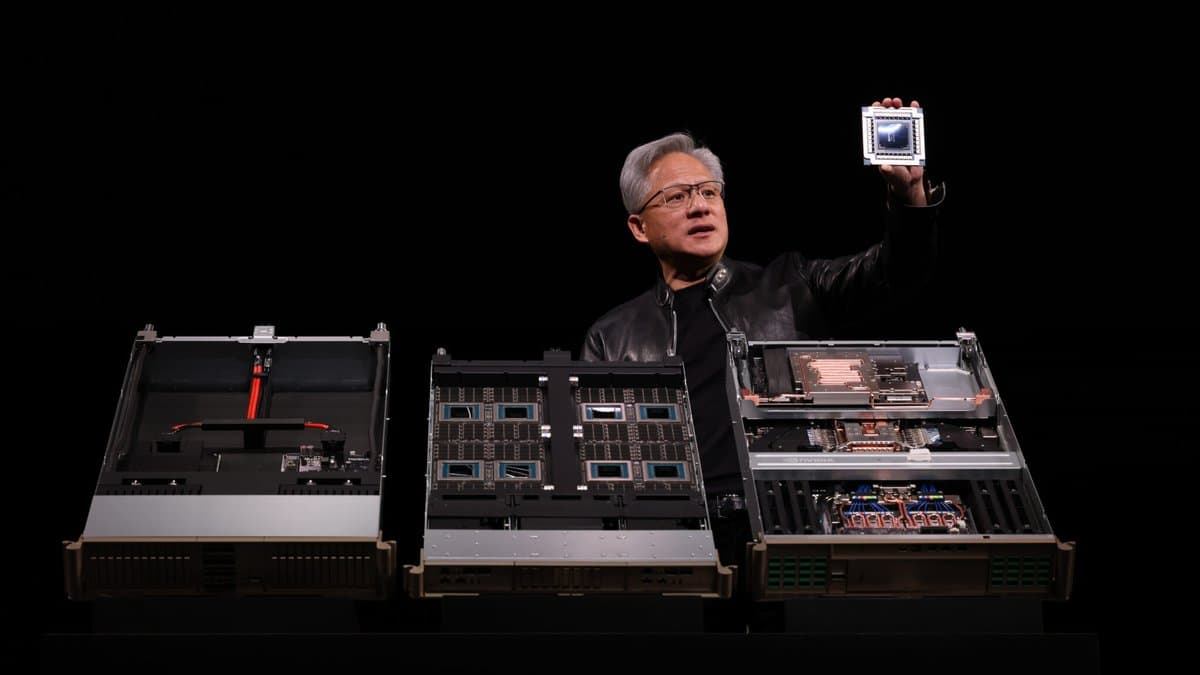

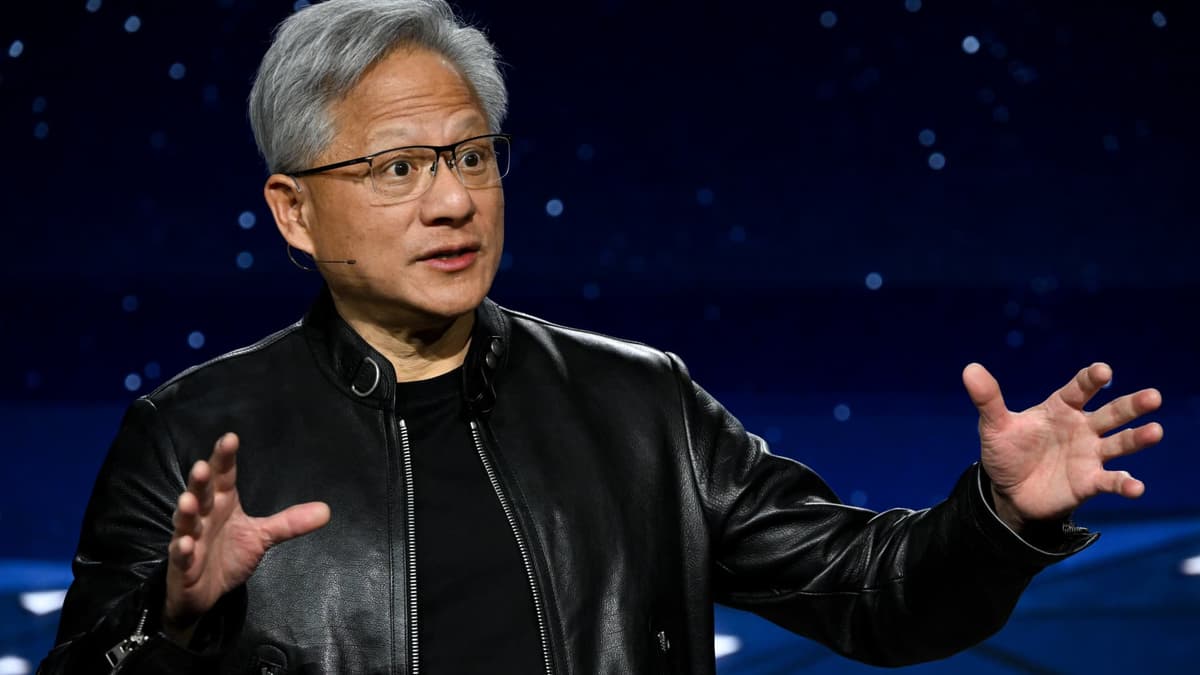

NVIDIA GTC 2026에서 젠슨 황 CEO는 깜짝 놀랄 만한 발표를 했어. 에이전틱 AI(Agentic AI)—사람의 지시를 받고 자율적으로 문제를 해결하는 AI. 그리고 그 에이전트를 움직이는 새로운 CPU, Vera.

이게 왜 중요할까? 지난 2년간 GPU는 LLM 시대를 주도했어. 하지만 에이전트는 다르다. 수천 개의 작은 결정과 도구 호출, 메모리 관리가 계속 일어나는데, 이걸 처리하는 CPU가 새로운 병목이 됐다는 거야. NVIDIA가 마침내 그걸 인정하고, 자신의 CPU로 것을 해결하겠다고 나선 거다.

엔터프라이즈 AI의 패러다임이 완전히 바뀌는 신호다.

이걸 이해하려면: 에이전틱 AI는 왜 지금 나온 건가

챗봇에서 에이전트로: AI의 진화 과정

GPT가 처음 나왔을 때만 해도 AI는 "당신의 질문에 답변하는" 도구였어. 사람이 물었고, AI가 대답했다. 끝.

하지만 지금은 달라졌어. 기업들이 AI를 실제 업무에 쓰기 시작한 거다.

예를 들어, 회계 팀이 "분기별 비용 리포트를 만들어줘"라고 했다고 하자. 에이전트는 이렇게 움직여:

- 데이터베이스에서 거래 기록을 불러온다 (도구 호출)

- 필요한 지출을 필터링한다 (로직)

- 계산해서 차트를 만든다 (또 다른 도구)

- 리포트 포맷에 맞게 정렬한다

- 최종 검증하고 승인자에게 전달한다 (또 다른 도구)

이건 단순히 "한 번의 답변"이 아니야. 수십, 수백 번의 작은 결정이 이어져야 해. 도구 선택, 에러 핸들링, 메모리 재할당—이 모든 걸 CPU가 조율해야 한다.

| 특성 | 챗봇 시대 (2023~2024) | 에이전트 시대 (2026~) |

|---|---|---|

| 입출력 | 질문 1개 → 답변 1개 | 목표 1개 → 여러 번의 도구 호출 |

| 병목 | GPU (추론) | GPU + CPU (오케스트레이션) |

| 응답 시간 | 초 단위 | 분 단위 |

| 메모리 관리 | 단순 | 복잡 (상태 유지, 컨텍스트 누적) |

| 실패 복구 | 다시 물어본다 | 자동 재시도, 경로 변경 |

에이전트는 단순히 더 똑똑한 챗봇이 아야. 근본적으로 다른 아키텍처가 필요해.

2024년만 해도 기업들은 LangChain, AutoGPT 같은 오픈소스 프레임워크로 에이전트를 만들려고 애썼어. 하지만 프로덕션 환경에서는 너무 느렸다. 왜? CPU가 따라가지 못했거든.

NVIDIA가 마침내 "우리가 CPU도 만들게" 라고 선언한 거는, 에이전틱 AI 시대가 본격적으로 시작된다는 신호야.

핵심 내용 해부: Vera CPU와 에이전트 플랫폼

Vera CPU: 왜 이름이 신성한가

NVIDIA는 전통적으로 GPU 회사였어. 근데 이제 CPU도 만든다니, 좀 이상할 수 있어.

하지만 논리는 명확해:

-

CPU-GPU 동기화의 문제: 지금까지 기업들은 에이전트를 만들 때 AMD나 Intel CPU + NVIDIA GPU 조합을 썼어. 그런데 이 둘 사이의 데이터 전송이 생각보다 느렸다. 메모리 버스가 병목이 되는 거다.

-

일관된 최적화: NVIDIA가 CPU도 만들면, 전체 칩스택(CPU + GPU + CUDA)을 한 회사가 관리할 수 있어. 훨씬 효율적인 최적화가 가능해진다.

-

2026년 이후의 필요성: 에이전트가 진짜 대규모로 배포되려면, 단순히 "빠른" CPU가 아니라 "에이전틱 워크로드에 특화된" CPU가 필요해. Vera가 바로 그거다.

Vera의 주요 스펙:

| 항목 | 상세 |

|---|---|

| 코어 수 | 192개 (전력 효율 중심) |

| 메모리 대역폭 | 초당 8TB 이상 (GPU와의 동기화 최적화) |

| AI 연산 지원 | 256-bit AI 연산 기본 지원 (Integer, FP32) |

| TDP | 300W 이하 (에너지 효율) |

| 타겟 워크로드 | 에이전트 오케스트레이션, 도구 호출 큐잉, 상태 관리 |

Vera는 "AI를 위한" CPU가 아니라 "에이전트를 위한" CPU야. 평범한 CPU 성능(싱글 스레드, 메모리 접근)보다는 에이전트 런타임의 특정 패턴—병렬 도구 호출, 빠른 컨텍스트 스위칭, 우선순위 큐 처리—에 최적화됐어.

Open Agents Platform: "에이전트는 오픈이어야 한다"

NVIDIA는 또 다른 핵심 발표를 했어. Open Agents Platform이라는 오픈소스 프레임워크를 공개한 거다.

이건 중요해. 왜냐하면:

-

표준화: 지금까지 에이전트 개발자들은 각자 다른 프레임워크로 에이전트를 만들고 있었어. LangChain, Crewai, AutoGPT... 통일된 표준이 없었다는 거다.

-

호환성: Open Agents Platform을 따르면, 한 번 만든 에이전트가 다양한 환경(AWS, Azure, on-prem)에서 그대로 작동한다.

-

NVIDIA의 노림: 당연히 이 플랫폼 위에서는 Vera CPU + NVIDIA GPU가 최고 성능을 낸다. 다른 조합도 돌아가지만, 최적화는 NVIDIA다.

오픈 플랫폼이 결국 NVIDIA를 이기는 게 아니라, NVIDIA를 표준으로 만드는 전략이야.

더 넓은 그림: 에이전틱 AI 전쟁, 이미 시작됐어

경쟁사는 뭘 하고 있는가

이건 NVIDIA만의 움직임이 아니야.

Google: 작년에 NotebookLM 에이전트를 공개했고, 최근에는 Gemini 2.0에 에이전트 능력을 통합했어. CPU는 따로 안 만들지만, TPU(자체 AI 칩)를 꾸준히 개선 중.

Microsoft: OpenAI와의 협력으로 Copilot 에이전트를 밀고 있어. Azure 클라우드 위에서 에이전트를 돌리려는 전략. 자체 CPU는 없지만, Maia 칩(AMD와의 협력)으로 비용을 낮추려고 노력 중.

Meta: Llama 에이전트를 오픈소스로 공개했어. 상대적으로 CPU 최적화에는 덜 관심이지만, 에이전트 프레임워크에 집중.

AMD: Vera에 대응할 CPU를 준비 중이라고 소문. 하지만 NVIDIA가 먼저 움직였고, 생태계 구축도 앞섰다.

2026년이 에이전틱 AI 표준 전쟁의 분수령이 될 거야. 누가 플랫폼을 점하는지에 따라 향후 10년 클라우드 인프라 시장이 결정될 거고.

Adobe와의 제휴: 크리에이티브 에이전트가 온다

GTC에서 가장 놀랐을 발표는 Adobe와의 전략적 파트너십이야.

Adobe가 뭐하는 회사 아니? Photoshop, Premiere 같은 크리에이티브 툴 회사다. 근데 이게 에이전틱 AI와 무슨 상관이 있어?

제일 가능성 있는 시나리오:

"당신의 크리에이티브 아이디어를 텍스트로 말하면, AI 에이전트가 Photoshop, After Effects, Stock 라이브러리를 자동으로 조작해서 최종 작업물을 만들어준다."

예를 들어:

- 크리에이터가 말한다: "봄 화사한 느낌의 소셜 미디어 배너 10개 만들어줘, 제품은 이거야"

- AI 에이전트가:

- Stock 라이브러리에서 배경 이미지를 찾는다 (도구 호출)

- Photoshop에 자동 레이어 구성을 한다 (Adobe API 호출)

- 텍스트, 색상, 폰트를 자동 배치한다

- 10개 변형을 한 번에 생성한다

- 클라우드에 저장한다

- 크리에이터는 검토만 하고 필요하면 세부 수정 지시

이게 가능해지면, 크리에이티브 워크플로우는 완전히 바뀐다.

Adobe의 Creative Cloud는 세계 약 2천만 유료 사용자가 있어. 그들 중 10분의 1이라도 AI 에이전트를 기본으로 쓰게 되면, 에이전트 시장은 막대해진다. 그리고 그 에이전트는 당연히 NVIDIA 인프라 위에서 작동할 거고.

그래서 뭐가 달라지는데

개발자들은 어떻게 대응할 건가

1단계: 에이전트 프레임워크 학습 (지금)

- Open Agents Platform 문서를 읽어.

- Python 에이전트 튜토리얼을 직접 짜봐.

- 기존의 chatbot 코드와 뭐가 다른지 이해해.

2단계: Vera CPU 사양 확인 (3~4개월 안에)

- NVIDIA가 정식 배포할 때 쯤.

- 자신의 에이전트가 Vera에서 효율적으로 돌 조건을 파악.

- 메모리 레이아웃, 도구 큐 구조 최적화.

3단계: 프로덕션 배포 (2026년 하반기~2027년)

- Vera CPU 탑재 서버 구축.

- Open Agents Platform 기반 에이전트 배포.

- 비용 대비 성능 측정.

비용은 어떻게 될까

지금 대규모 LLM 추론은 GPU만으로도 억 대 비용이 들어. 여기에 CPU를 더하면? 비용이 뛸까, 떨어질까?

낙관적 시나리오:

- Vera는 에이전트 오케스트레이션을 효율화해서, 같은 작업을 30~40% 더 싸게 할 수 있다.

- 에이전트가 도구를 더 똑똑하게 선택해서 불필요한 GPU 연산을 줄인다.

비관적 시나리오:

- Vera CPU 자체 비용이 추가된다.

- 기존 AMD/Intel CPU 기반 에이전트도 충분히 작동하므로, 비용 이점이 명확하지 않으면 채택이 더디다.

현실은 아마 그 중간일 거야. 초기에는 비용이 더 들지만, 6~12개월 뒤 대규모 배포가 늘면서 규모의 경제로 비용이 내려올 거다.

비즈니스 기회는 어디에

-

에이전트 개발사: Open Agents Platform으로 표준화되니까, 이제 에이전트 개발이 진짜 산업이 된다. 엔터프라이즈급 에이전트를 팔 수 있는 회사들이 나올 거다.

-

NVIDIA 에코시스템 구축사: Vera 기반 서버, 호스팅 서비스를 제공하는 회사들. AWS, Azure는 이미 준비 중일 거고.

-

도메인 특화 에이전트: 의료(진단 보조), 금융(거래 자동화), 법률(계약 검토) 같은 분야별 특화 에이전트 개발. 여기서 진짜 가치가 생긴다.

-

크리에이티브 에이전트: Adobe 파트너십으로 활로가 열렸어. 비디오 제작, 그래픽 디자인, 음악 생성 자동화 분야.

참고 자료

관련 기사

AI 트렌드를 앞서가세요

매일 아침, 엄선된 AI 뉴스를 받아보세요. 스팸 없음. 언제든 구독 취소.